L. Pandolfi

Lezioni di Analisi Matematica 2

Il testo presenta tre blocchi principali di argomenti:

A

Successioni e serie numeriche e di funzioni:

Cap.

1, e

2.

B

Questa parte consta di due, da studiarsi

in sequenza.

B1 Funzioni di più variabili

e integrazione (multipla, di curva e

di superficie): Cap.

3–

8.

B2 Campi

conservativi,Cap.

9.

C

Sistemi di equazioni differenziali: Cap.

10.

Lo studio dei blocchi A e B può scambiarsi di ordine senza problemi. Invece, è

consigliabile studiare C per ultimo. Infatti, lo studio del Cap. 10 richiede il

concetto di continuità e differenziabilità di funzioni di più variabili, studiato ai

paragrafi 4.1–4.2. Ovunque nello studio del Cap. 10 è necessario conoscere il

concetto di curva (ma non le proprietà differenziali delle curve, né gli integrali di

curva). L’esponenziale di matrici richiede la definizione di serie, Cap. 1, e 2 e il

paragrafo 10.4 richiede il Cap. 9.

Indice

Elenco delle figure

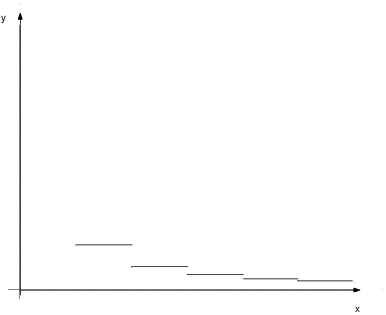

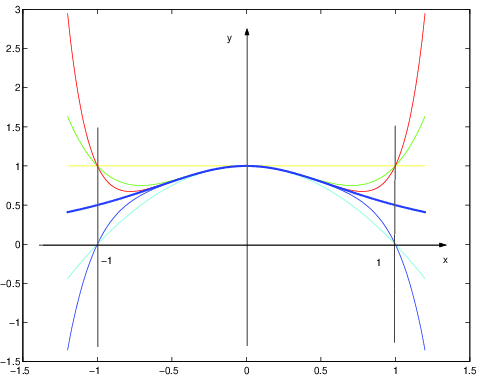

1.1 Il test di MacLaurin1.2

a sinistra, a

destra 1.3

a sinistra, a

destra 1.4 a

sinistra e a

destra2.1 Distanza

2.2 Le distanze

e 2.3 Convergenza

uniforme e convergenza in media2.4 La convergenza uniforme non implica

la convergenza della successione delle derivate2.5 Gli intervalli che si

usano nella dimostrazione del teorema di Abel2.6 Somme parziali della

serie (2.3) (a sinistra e della serie (2.4) (a destra)2.7 Somma parziali della

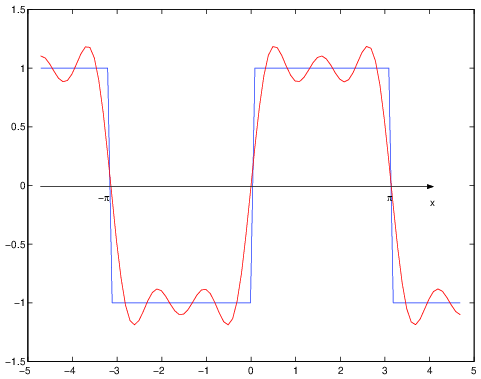

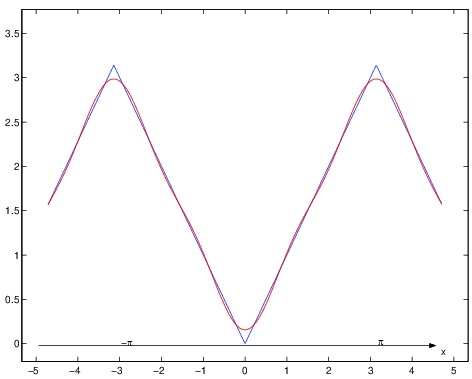

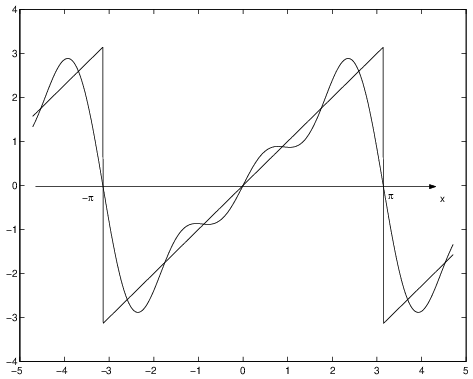

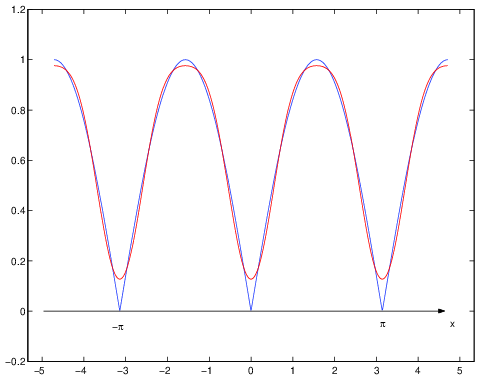

serie (2.5)2.8 Illustrazione del Teorema 83 2.9 Estensione per periodicità

della funzione (2.32)2.10 Il fenomeno di Gibbs 2.11 Le serie di Fourier delle

restrizioni a

di (sinistra

sopra ), di (destra

sopra), di

(sinistra sotto) e di (destra

sotto) 3.1 Insieme connesso, a sinistra, e convesso a destra. 3.2 Senso

positivo di rotazione e verso sugli assi coordinati3.3 Sfera di centro

l’origine in norme diverse3.4 Teorema di Pitagora e identità

del parallelogramma 3.5 Calcolo dell’area di un parallelogramma

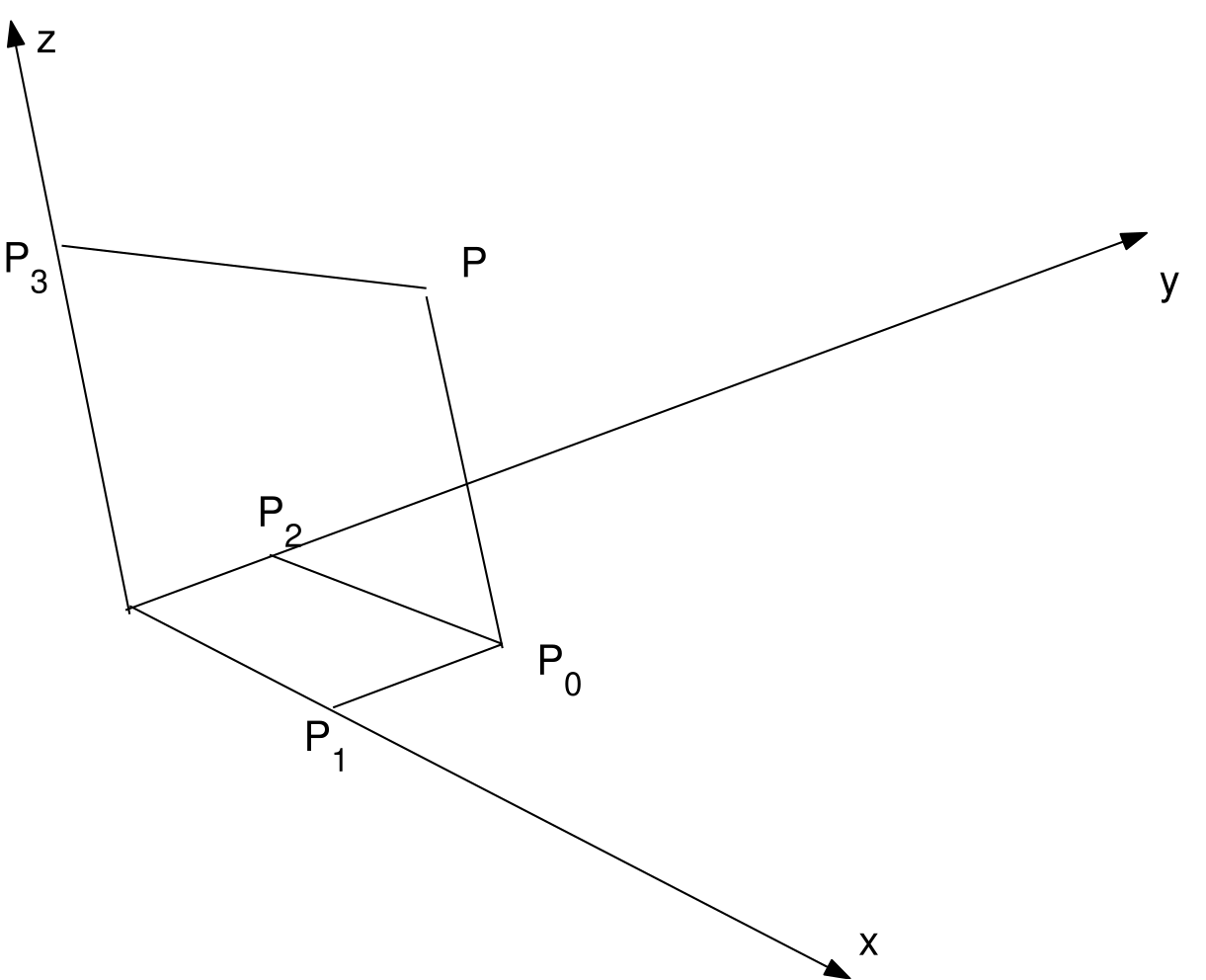

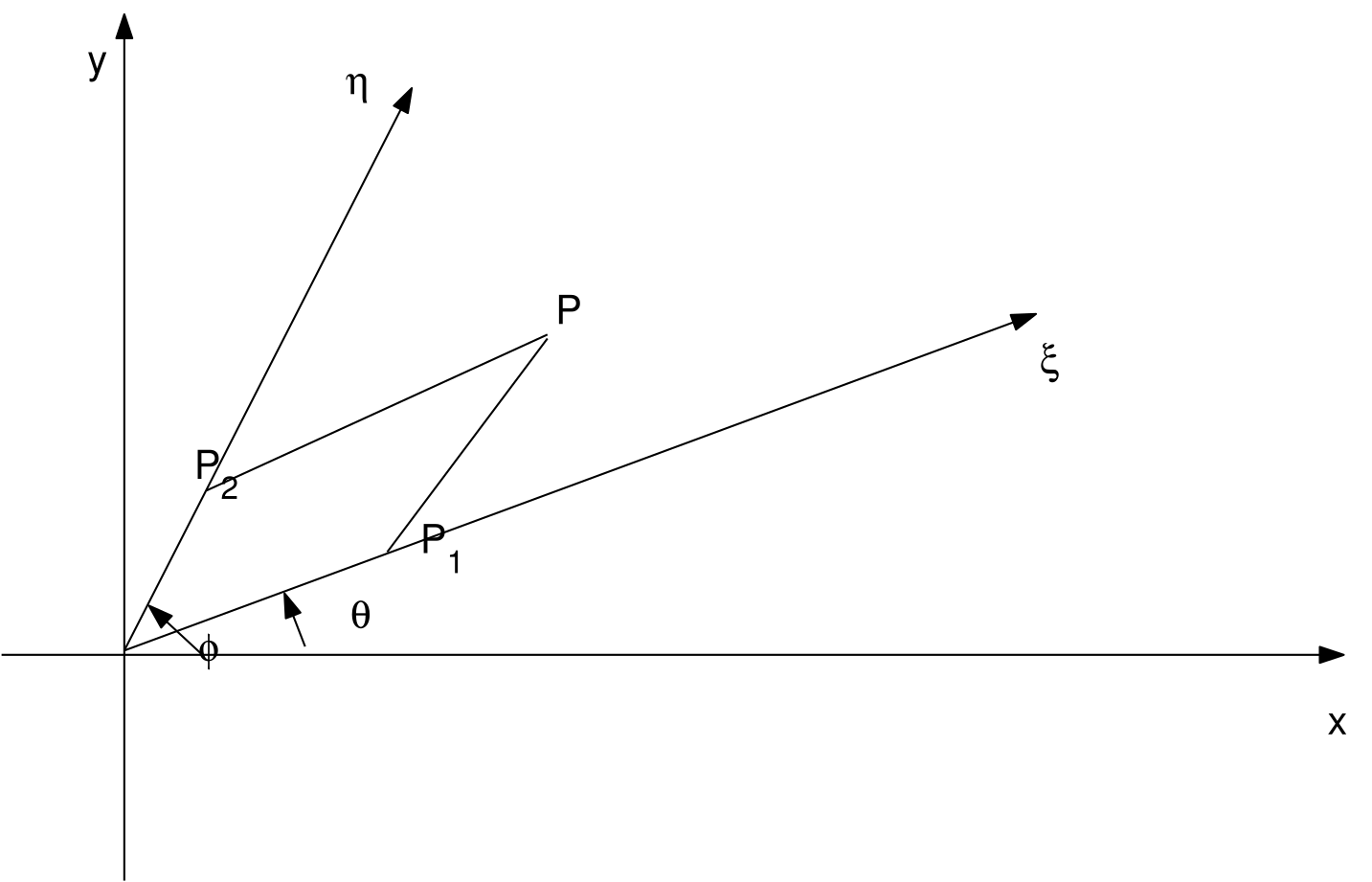

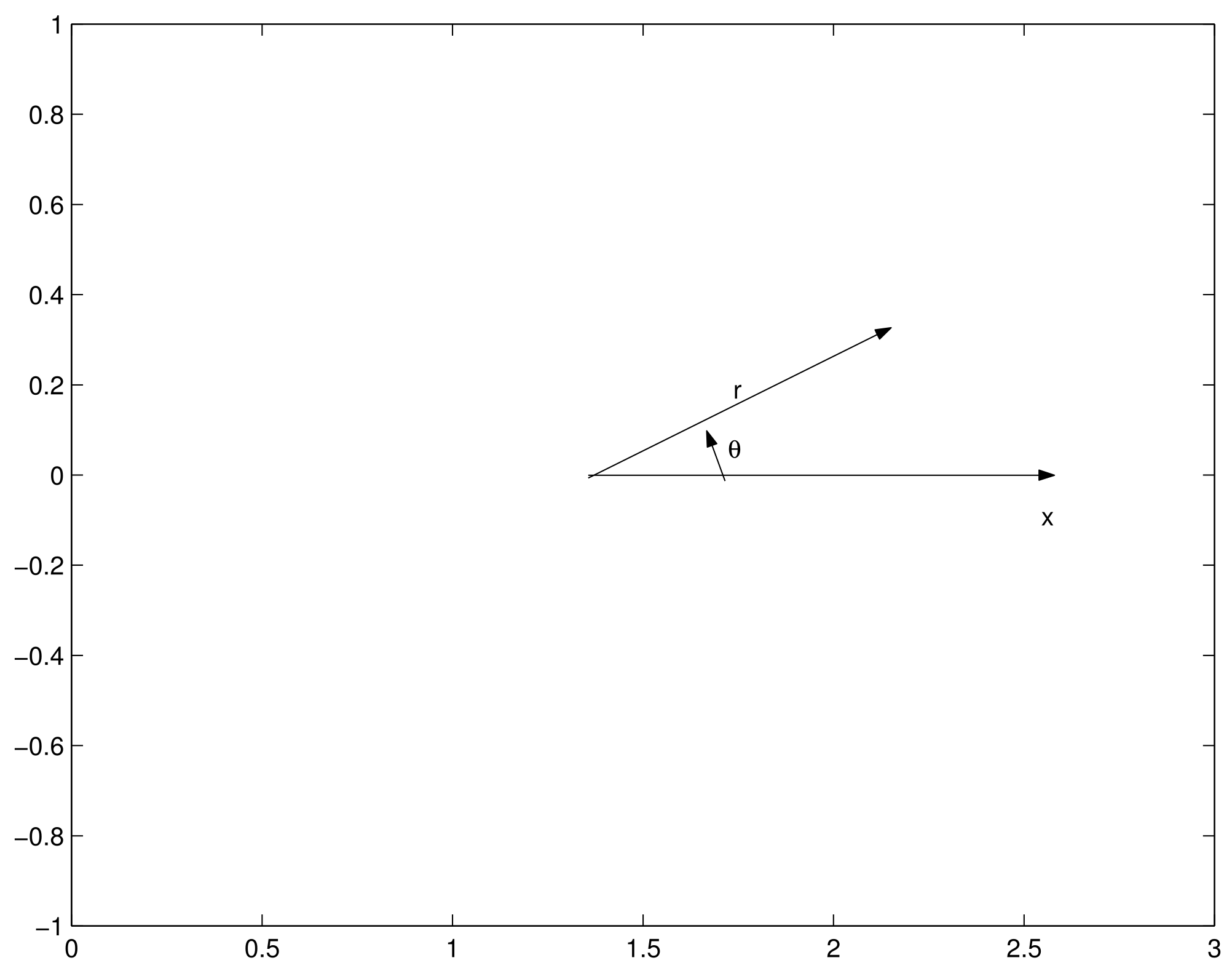

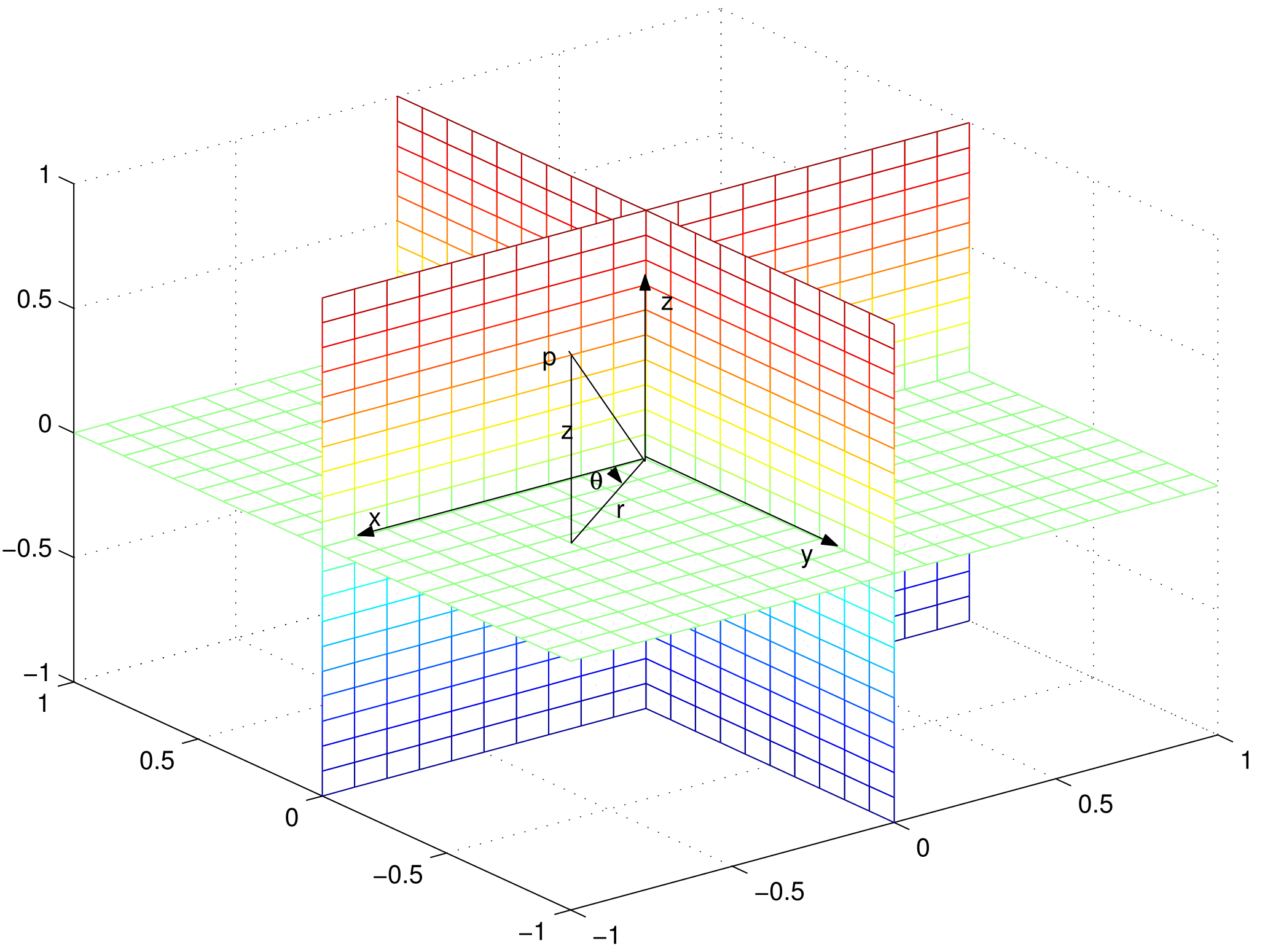

3.6 Coordinate oblique3.7 Trasformazione a coordinate oblique3.8 coordinate

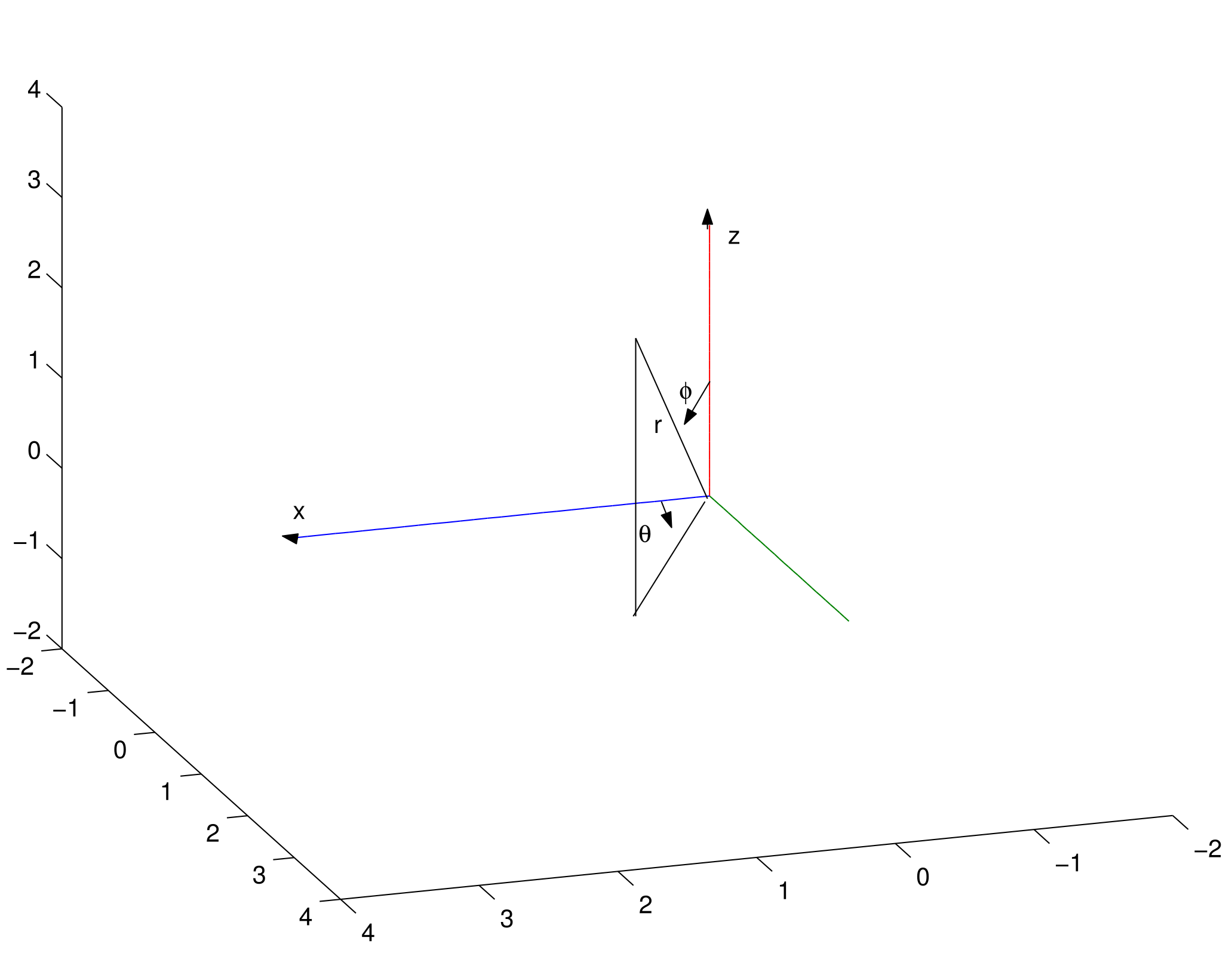

polari3.9 coordinate cilindriche 3.10 coordinate sferiche 4.1 La funzione

dell’esempio 1264.2 Piano tangente e vettore normale4.3 Un punto di

minimo e un punto di sella4.4 Un parallelogramma, la sua immagine e il

parallelogramma che la approssima4.5 un campo vettoriale4.6 Paraboloide

di rotazione4.7 Paraboloide di rotazione e sue curve di livello4.8 La

funzione (4.10)4.9 Una funzione omogenea4.10 Funzione omogenea di grado

4.11 Superficie

di rotazione4.12 Una funzione periodica4.13 La funzione (4.11)4.14 La

funzione (4.12)4.15 Lunghezza d’onda5.1 Esistenza o non esistenza

della funzione implicita5.2 La dimostrazione del teorema della funzione

implicita5.3 Il grafico della funzione 5.4 Esiste

la funzione implicita anche se le condizioni del teorema non sono

soddisfatte5.5 Il grafico della funzione (5.8)5.6 Gradiente nullo ma curva

di livello regolare5.7 Intersezione di due cilindri5.8 Estremi vincolati

e curve di livello5.9 Grafici tangenti e estremi vincolati5.10 6.1 Le

curve (6.1) e (6.3)6.2 La definizione di lunghezza: una curva e i suoi

vettori approssimanti6.3 Versore tangente e versore normale6.4 Le

regioni interna ed esterna e la normale esterna6.5 Regola d’Ampère

per una curva piana6.6 Insieme su cui si proietta una calotta6.7 Una

calotta ed il suo “bordo”6.8 Ancora una calotta col suo “bordo”6.9 Il

piano tangente e la normale ad una superficie6.10 Riferimento mobile

su una curva nello spazio7.1 Domini di integrazione7.2 Suddivisione in

rettangoli di un dominio di integrazione7.3 Riduzione di un integrale

doppio7.4 Riduzione per fili e per strati di un integrale triplo7.5 Volume

di una superficie di rotazione8.1 “Operazioni” sugli archi8.2 Gli

archi (8.8) e (8.9) a sinistra. A destra una regione delimitata da due

archi8.3 Archi che “si elidono”8.4 Integrali di curva di seconda specie ed

archi che “si elidono”8.5 Il flusso8.6 Versi di percorrenza8.7 Formula di

Green8.8 Area di una regione di Jordan8.9 Estensione della formula di

Green8.10 Area di una calotta8.11 Calotta di rotazione (caso particolare:

paraboloide di rotazione)8.12 Flusso attraverso una superficie8.13 Una

sfera e la parte “sotto l’equatore”8.14 Le due regioni8.15 Una sezione

della regione8.16 Ancora la regione8.17 Le due orientazioni del

bordo8.18 Estensione al caso del cilindro8.19 Estensione ad una superficie

non regolare8.20 La costruzione del nastro di Möbius8.21 Il cilindro

e il nastro di Möbius9.1 Un campo vettoriale conservativo ed uno non

conservativo10.1 Spezzata di Eulero 10.2 Nodo e punto di sella 10.3 Centro

e fuoco 10.4 Nella definizione di stabilità in generale si deve scegliere

10.5 Il

caso dell’esempio 277: la limitatezza delle soluzioni non implica la stabilità

10.6 Integrali primi e stabilità 10.7 Il caso considerato nell’esempio 285

Capitolo 1

Serie numeriche

Le serie numeriche vogliono generalizzare la somma di un numero finito di termini

al caso in cui si sommano infiniti termini. Per questo si introduce il limite di una

opportuna successione di “somme parziali”. Prima di tutto quindi ricapitoleremo i

concetti fondamentali relativi alle successioni numeriche.

1.1 Successioni numeriche: ricapitolazione

Una successione numerica è una funzione definita su

ed a valori

in (oppure

in . Noi

qui ci limitiamo a considerare successioni a valori reali). Una successione si indica col

simbolo e si

sottintende che .

Talvolta,

è un qualsiasi numero intero maggiore od uguale ad un certo

che può

anche essere negativo. Se è necessario specificare il primo dei valori dell’indice

scriveremo

. La

successione si chiama:

- “limitata” quando esiste

tale che

per ogni ;

- “convergente”, quando esiste finito il limite ,

che spesso si indica semplicemente come ;

- “divergente” quando

oppure quando ;

- “regolare” quando è convergente oppure divergente;

- “oscillante” quando non è regolare; ossia quando

non esiste, né finito né

né .

Ricordiamo che una successione si dice fondamentale o di Cauchy quando

per ogni

esiste un

tale che

per ogni

e per ogni

si ha:

In simboli:

Vale:

Teorema 1 Ogni successione convergente è fondamentale; ogni successione

fondamentale è limitata e quindi ogni successione convergente è limitata.

Naturalmente, esistono successioni limitate e non convergenti. Per esempio la successione di

termine generale .

Invece:

Teorema 2 Ogni successione fondamentale è convergente.

Dim. Accenniamo ai passi cruciali della dimostrazione, che si trova nei testi di Analisi Matematica 1. Sia

la successione. Prima di tutto

si prova che la successione

ammette s.successioni convergenti. Questo si vede così: dato che una successione fondamentale è limitata,

l’immagine di ,

ossia l’insieme

è limitato. Se è finito, almeno uno dei suoi elementi è immagine di infiniti

e quindi la successione

ha una s.successione

costante e quindi

convergente, di ciamo ad .

Se l’insieme

è infinito, esso ammette almeno un punto di accumulazione

,

per il Teorema di Bolzano-Weierstrass. Si costruisce quindi una s.successione

convergente

ad .

L’ultimo passo della dimostrazione consiste nel mostrare che è la successione

stessa che

converge ad ,

usando la definizione di successione fondamentale. _ Una successione

è crescente

quando implica

; decrescente

quando

implica .

Un altro risultato importante da ricordare è il teorema delle funzioni monotone, la

cui formulazione particolarizzata al caso delle successioni è la seguente:

Teorema 3 Sia

una succesione monotona. Esiste

ossia, ogni successione monotona è regolare.

Infine, ricordiamo che se una successione

è regolare, anche la successione che si ottiene da essa trascurandone un numero finito di termini,

ossia è regolare, ed

ha il medesimo limite.

1.2 Le serie numeriche

Sia

una successione di numeri. Per fissare le idee sia

, ma

in modo analogo si può trattare il caso in cui il primo indice sia per esempio

o comunque sia

diverso da . Si chiama

serie dei numeri una

nuova successione

costruita come segue:

|

| (1.1) |

ossia, detto in modo più conciso:

I numeri si chiamano le

somme parziali della serie.

La nuova successione

si indica anche col simbolo

I numeri

si chiamano i termini della serie e si dice che

è il termine

generale della serie. Nella definizione precedente niente si richiede al comportamento della

successione o della

successione . Se

però la successione

converge allora si dice che la serie converge; se la successione

diverge (a

oppure a

)

allora si dice che la serie diverge (rispettivamente a

oppure a

). Se la

successione

è priva di limite, si dice che la serie è oscillante o indeterminata.

Una serie si dice regolare quando converge oppure diverge. Il carattere

della serie o comportamento della serie è la proprietà di essere

convergente, divergente o oscilante. Ricapitolando, se la successione

converge

ad

oppure diverge, dovremmo indicare questo col simbolo

rispettivamente

uguale a

oppure

oppure .

Più brevemente si scrive

Si dice brevemente che

è la somma della serie. Ovviamente, scambiando l’ordine di un numero finito di

termini di una serie, non si cambia nè il comportamento della serie nè la sua

somma, nel caso che la serie sia convergente (diremo più avanti cosa accade

scambiando tra loro infiniti termini della serie). E’ anche vero che, sopprimento o

aggiungendo un numero finito di termini, oppure cambiando il valore di un numero

finito di termini, la serie rimane convergente, divergente o oscillante; ossia:

Teorema 4 Il carattere di una serie non muta alterandone un numero finito

di termini.

Va detto esplicitamente che se la serie è convergente, la somma della

serie cambia alterandone un numero finito di termini. Se invece è

divergente, la sua somma non cambia.

Inoltre:

Teorema 5 Se

converge allora .

Dim. Si indichi con . L’ipotesi è

che la successione converge e

quindi anche la successione

converge, ed al medesimo limite. Dunque,

Di conseguenza:

Esempio 6 La serie di “termine generale” ,

ossia la serie

non converge. _

Invece:

Esempio 7 La successione

(con

fissato) si chiama progressione geometrica (di ragione ).

La serie

si chiama serie geometrica E’ noto che, se ,

e quindi

Si noti che la serie geometrica per definizione inizia con l’indice .

Se per qualche ragione si deve iniziare con un primo indice diverso, di ciò va

tenuto conto nel calcolo della somma. Per esempio

1.2.1 Serie telescopiche

Sia

una successione e sia

(ovviamente definita per ).

Consideriamo la serie

Una serie ottenuta con questo procedimento si chiama serie telescopica E’ facile

calcolare le somme parziali di una serie telescopica:

e, in generale,

Dunque:

Teorema 8 La serie telescopica costruita sopra converge se e solo se

e in tal caso

diverge se

oppure se .

La serie è oscillante se e solo se la successione

è priva di limite.

Esempi

Vediamo alcuni esempi.

Esempio 9 Consideriamo la serie

Questa serie diverge. Infatti,

Sia ha quindi una serie telescopica e

Esempio 10 Consideriamo la serie

Si vede che questa è una serie telescopica notando che

e inoltre .

Dunque,

Se per qualche ragione si devono sommare i termini con ,

allora

Consideriamo ora la serie

Decomponendo in fratti semplici,

Si tratta quindi di una serie telescopica, la cui somma è . _

Infine:

Esempio 11 Anche la serie seguente è una serie telescopica:

Infatti,

e quindi la serie è uguale a

Dunque, la serie converge e la sua somma è . _

Nonostante gli esempi importanti della serie geometrica e delle serie telescopiche,

calcolare esplicitamente le somme parziali di una serie è pressoché impossibile.

L’unica cosa che si può fare è dare condizioni per la convergenza o divergenza di

serie, e quindi, se già si sa che la serie converge, approssimarne numericamente la

somma.

1.3 Criteri di convergenza

Come si è detto, è ben diffcile calcolare esplicitamente le somme parziali di una

serie. Per questo è necessario conoscere dei criteri che assicurino la convergenza o

meno di una serie, senza calcolarne le somme parziali. Dato che la somma

di una serie è il limite della successione delle somme parziali, dovremo

basarci su criteri per l’esistenza del limite, che non facciano intervenire la

preliminare conoscenza del limite stesso. Essenzialmente, questi criteri si

riducono a due soli: il teorema di Cauchy per le successioni e il teorema

delle funzioni monotone. Esaminiamone le conseguenze per il caso delle

serie.

1.3.1 Il teorema di Cauchy per le serie

Vediamo come si trascrive il Teorema di Cauchy nel caso in cui

è la

successione delle somme parziali della serie

Sia, per fissare le idee,

.

Allora,

Possiamo quindi enunciare il Teorema di Cauchy come segue:

Teorema 12 La serie (1.3) converge se e solo se per ogni

esiste

tale che per ogni coppia di indici ,

con

vale

D’altra parte, notiamo che

e quindi:

Corollario 13 Se la serie

converge, anche la serie

converge.

Dim. Infatti, se

converge, per ogni

esiste tale

che per

si ha

E quindi anche la serie

converge, grazie al Teorema 12. _ Più avanti vedremo una

diversa dimostrazione di questo corollario. Si dice che la serie

converge assolutamente quando è convergente la serie

. Il

corollario precedente quindi può enunciarsi in questo modo:

Teorema 14 Una serie assolutamente convergente è convergente.

Questo risultato è molto importante perché la serie

è una serie a termini positivi. Criteri di convergenza facilmente usabili

esistono appunto per il caso delle serie a termini positivi, come ora andiamo a

vedere.

1.3.2 Monotonia e serie a termini di segno costante

Usando il teorema delle funzioni monotone, è facile vedere che

Teorema 15 Sia

una successione a termini positivi. La serie degli

converge se e solo se esiste

tale che

per ogni .

Dim. Ricordiamo il significato di :

prima si costruisce la successione

e poi si studia il limite .

La successione è

crescente perché, essendo

per ogni ,

Dunque la successione

ammette limite, finito o meno, per il teorema delle funzioni monotone. Il limite è finito se e solo

se la successione

è superiormente limitata, ossia se e solo se esiste

tale che

per ogni

. _ Il

teorema facilmente si estende al caso di successioni a termini negativi oppure

definitivamente positive o negative. Inoltre:

Teorema 16 (Teorema del confronto) siano

e

due serie a termini positivi, con

per ogni .

Allora, se

converge, anche

converge; se

diverge lo stesso fa .

Questo semplice risultato ha come conseguenza due importanti criteri di convergenza

per le serie a termini positivi:

Teorema 17 (Criterio della radice) Sia

per

ogni :

Dim. Da

segue infatti e, se

, la convergenza

della serie

segue dall’esempio 7 e dal Teorema del confronto. Se per un

vale

allora

Di conseguenza il termine generale della serie non tende a zero, e quindi la serie

non converge. _ Si ha inoltre:

Teorema 18 (Criterio del rapporto) Se vale definitivamente

allora

converge; se

allora

diverge.

Dim. Proviamo l’asserto nel caso in cui la (1.4) valga per ogni

. Se

allora

,

e, in

generale, . Si

sa che se

allora

converge, si veda l’esempio 7. L’asserto segue quindi dal Teorema del confronto. In

modo analogo si vede il secondo asserto. _ Ricordando i teoremi sui limiti, si può

enunciare il corollario seguente:

Corollario 19 Sia

una serie a termini positivi. Vale:

- se

allora la serie converge;

- se

allora la serie converge;

- se

allora la serie diverge;

- se

allora la serie diverge.

Concludiamo con un esempio:

Esempio 20 Consideriamo la serie

Mostriamo che questa serie è divergente. Si noti che per ogni

vale

Infatti, la funzione

è concava e quindi ha grafico che sta sotto a ciascuna delle sue tangenti; e

è la

tangente nell’origine. In particolare vale

Abbiamo visto che la serie a termini positivi

diverge, si veda l’esempio 9. Dunque, per confronto, anche la serie (1.5)

diverge. _

La serie (1.5) si chiama serie armonica. Si osservi che il carattere della serie

armonica non può determinarsi usando il criterio del rapporto oppure quello della

radice. Infatti, nel caso della serie armonica,

All’esempio 24 vedremo una serie di termine generale

che

è convergente e tale che anche per essa vale

Combinando questi due esempi si ha:

niente può dedursi dai criteri della

radice e del rapporto, se il numero

che compare in tali criteri è uguale ad

.

Le serie a termini positivi hanno una notevole proprietà, che non è condivisa dalle

generiche serie a termini di segno variabile: se si altera l’ordine di infiniti termini di

una serie si trova una nuova serie, che generalmente ha un comportamento diverso

da quello della serie di partenza. Invece:

Teorema 21 Due serie a termini positivi, con gli stessi elementi in ordine

diverso, hanno la medesima somma.

La formula di Stirling

Per ragioni che vedremo, molto spesso il termine generale di una serie contiene dei

fattoriali. I fattoriali hanno un “buon comportameno” rispetto al rapporto, nel

senso che permettono facilmente di fare semplificazioni. Invece, il criterio della

radice sembra diffcile da usare in presenza dei fattoriali. In realtà non è

così grazie alla formula di Stirling

|

| (1.6) |

La dimostrazione si trova nei testi di Analisi Matematica 1.

1.3.3 Il test di MacLaurin

Consideriamo le somme parziali di una serie a termini positivi

Esse sono

Queste espressioni si possono interpretare come somma di aree di rettangoli interpretando

come misura

della base ed

come misura dell’altezza.

ove

è la funzione costante a tratti

Dunque, la somma della serie è l’integrale improprio di

:

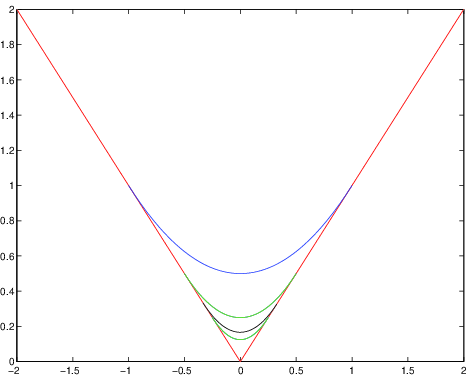

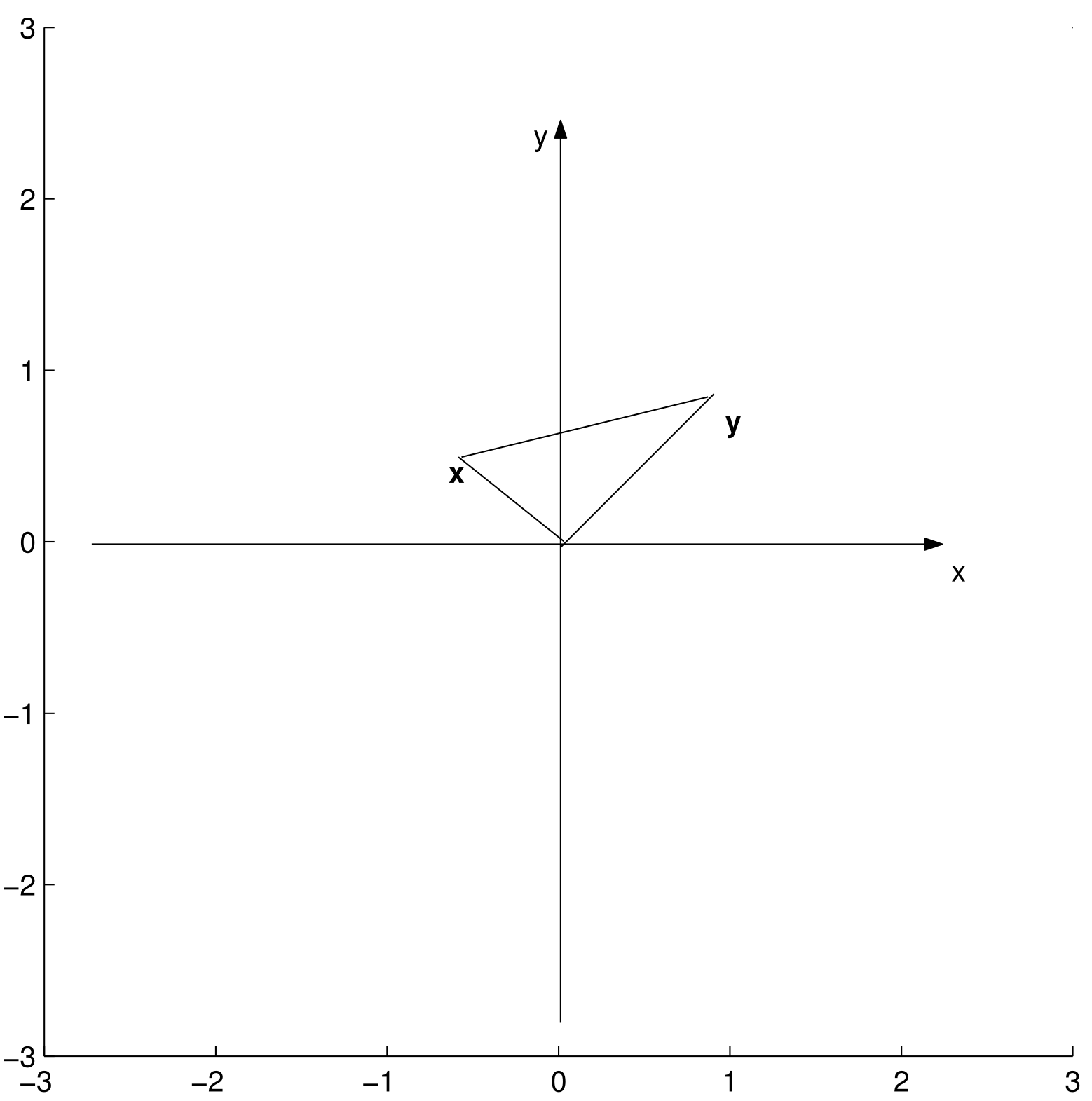

Pensiamo ora ai rettangoli messi come in figura 1.1, a sinistra, e supponiamo di poter trovare

due funzioni,

e , che

prendono valori maggiori o uguali a zero e tali che inoltre valga

Si veda la figura 1.1, a destra. In tal caso si ha

La serie è a termini positivi e quindi regolare; le funzioni sono non negative e

quindi ammettono integrale improprio finito o meno. Dunque, dal teorema di

confronto per i limiti, si ha

Ricapitolando,

- Se

allora la serie diverge;

- Se

allora la serie converge. In questo caso si trovano anche stime, da sotto

e da sopra, per la somma della serie.

Il caso tipico in cui quest’argomento si applica facilmente è il caso in cui esiste una funzione

definita

su ,

decrescente e inoltre

In questo caso,

|

| (1.7) |

Definiamo, per ,

e notiamo che la (1.7) si scrive

Inoltre,

|

|

Ossia, nel caso descritto, i due integrali impropri hanno il medesimo

comportamento e questo comportamento è ereditato dalla serie. Possiamo quindi

enunciare:

Teorema 22 (Test di MacLaurin) Sia

una funzione non negativa e decrescente definita su .

Si consideri la serie

Le sue somme parziali verificano

|

| (1.8) |

In particolare, la serie a termini positivi

converge se e solo se

L’interesse di questo teorema sta nel fatto che talvolta l’integrale di

può

esplicitamente calcolarsi mediante il calcolo delle primitive; e comunque esistono

test effcienti per lo studio della convergenza o divergenza degli integrali impropri.

Esempio 23 Si sa già che la serie armonica

diverge. La serie

converge, come si vede dal criterio di MacLaurin. Infatti, la funzione

ha integrale improprio convergente:

Procedendo in modo analogo

si provi invece che

Esempio 24 Si calcola immediatamente

Dunque,

converge per ,

diverge altrimenti. _

Possiamo combinare l’esempio 24 col criterio di confronto, ottenendo:

Corollario 25 Consideriamo la serie

.

Vale:

In particolare, possiamo enunciare:

Se

e se

esiste

tale che

allora la serie

converge.

Per ora, stiamo lavorando con serie a termini positivi, ma non abbiamo scritto

esplicitamente questa condizione perché vedremo, al Corollario 27, che il test

precedente vale per ogni serie.

1.3.4 Serie a termini di segno qualsiasi

Sulle serie a termini di segno qualsiasi, limitiamoci ad

osservare due proprietà. Si è già detto che se la serie

converge, si

dice che la serie

converge assolutamente. Ricordiamo, dal teorema 15:

Teorema 26 Una serie assolutamente convergente è convergente.

Ricordiamo ora che quando

è un infinitesimo, e

ciò accade se e solo se

è un infinitesimo. Quindi:

Corollario 27 Se esite

tale che ,

allora la serie

converge assolutamente, ed è quindi convergente.

Infine, si dice che una serie è a segni alterni se ha forma

|

| (1.10) |

ossia se gli addendi si susseguono cambiando segno ad ogni passo. Esiste, per le

serie a segni alterni, una notevole condizione suffciente di convergenza, e anche una

stima per la somma della serie:

Teorema 28 (Criterio di Leibniz) Se valgono ambedue le condizioni

-

- la succesione

è decrescente, ossia

per ogni

allora la serie a segni alterni (1.10) converge; inoltre, detta

la somma della

serie, per ogni

vale:

La dimostrazione della convergenza è nell’Appendice 1.8.2.

Esempio 29 Consideriamo la serie

Questa serie si chiama serie di Mengoli Il criterio di Leibniz mostra che questa

serie converge. La somma della serie è nota:

Il Teorema 28 dà anche una stima dell’errore che si commette sommando

termini: l’errore è minore di . _

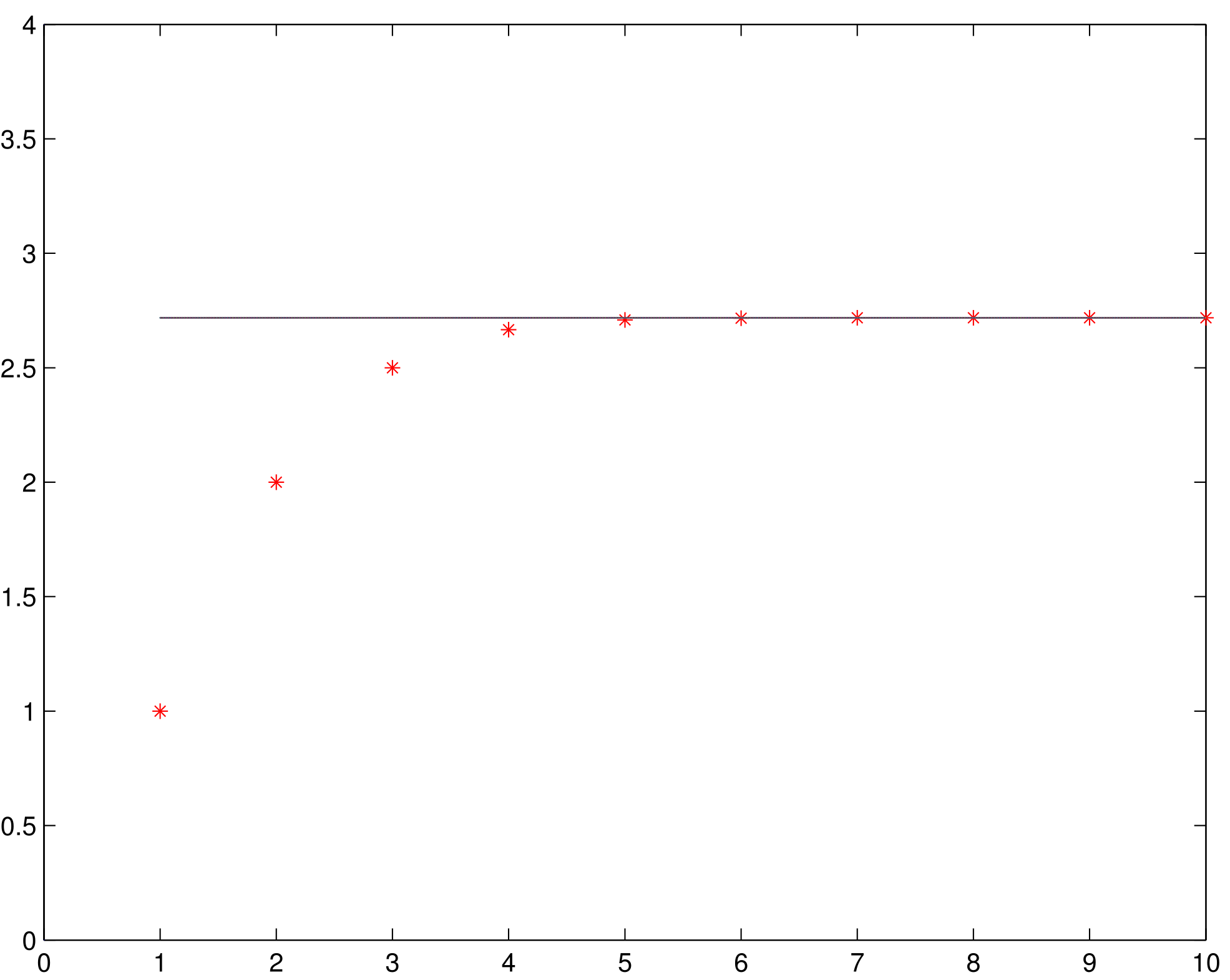

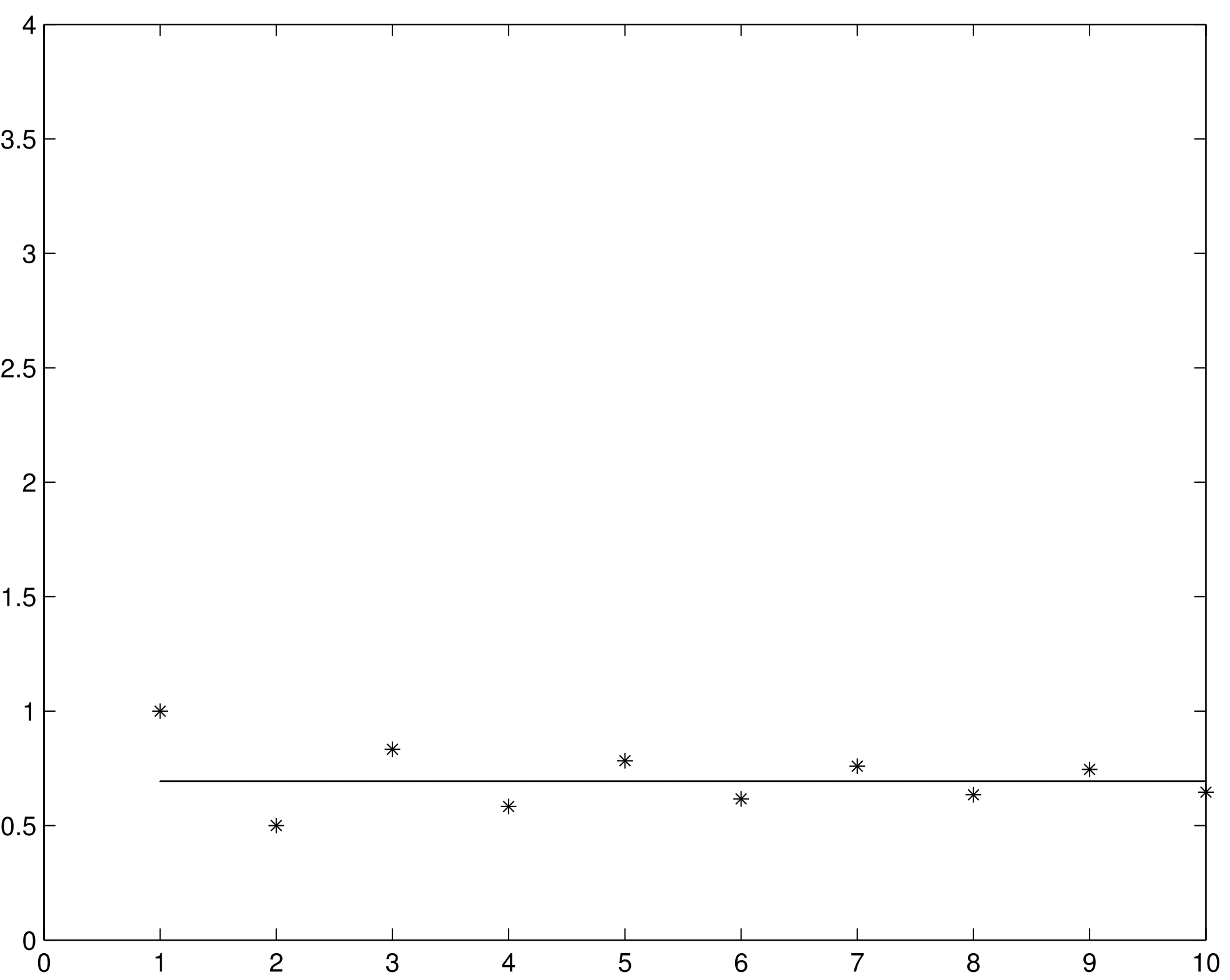

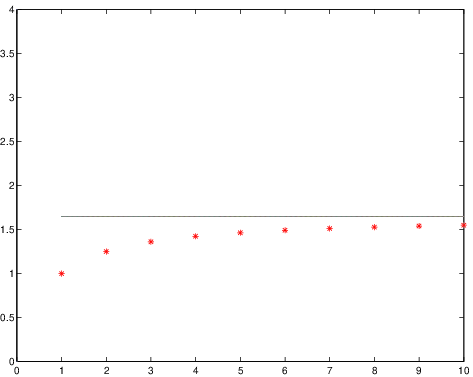

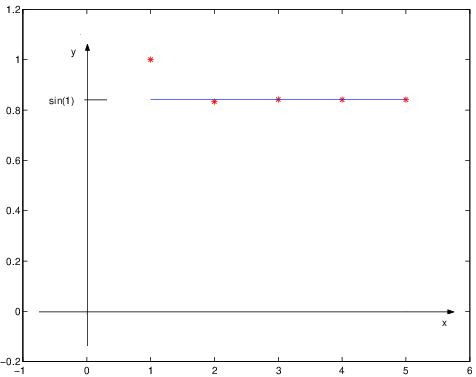

1.4 Alcuni esempi numerici

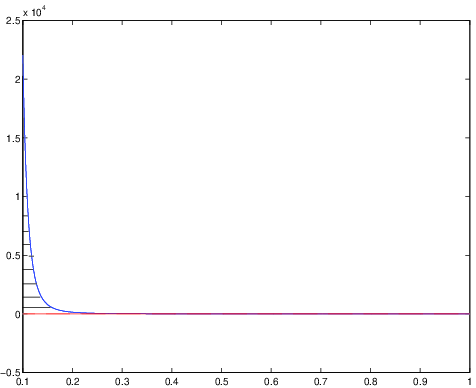

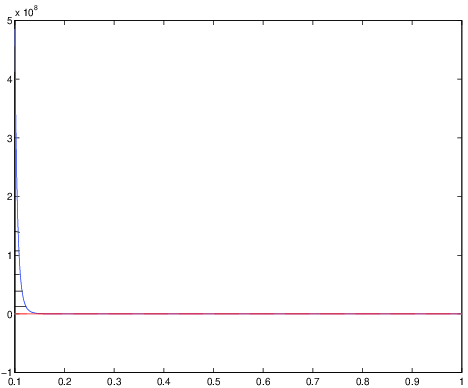

Le figure 1.2, 1.3 e 1.4 mostrano alcuni esempi numerici di somme parziali di

serie convergenti. Le serie sono specificate nelle intestazioni delle figure.

1.5 Convergenza condizionata ed incondizionata

Il concetto di serie generalizza quello di somma finita. In una somma finita il

risultato non dipende dall’ordine degli addendi (proprietà commutativa

dell’addizione). Nel caso delle serie, l’asserto analogo vale se si scambiano tra di loro un

numero finito di termini. E’ FALSO se si scambia il posto di infiniti termini. Mostriamo

un esempio:

Esempio 30 Consideriamo la serie di Mengoli .

Si sa che questa serie converge. Mostriamo che è possibile scambiare il posto di

infiniti termini, in modo da ottenere una serie divergente a .

Ricordiamo per questo che

diverge e quindi anche

diverge. Conviene vedere una dimostrazione di questo fatto, diversa da quella

già vista: consideriamo

(si è usato il fatto che si sommano

termini, ciascuno dei

quali è maggiore di ).

Ciò contrasta col criterio di convergenza di Cauchy, e mostra che la serie diverge.

Dato che il carattere di una serie non dipende dai primi elementi, anche ciascuna

delle serie

è divergente. Ora consideriamo la serie di Mengoli, per semplicità cambiata di segno.

Essa converge a .

Vogliamo riordinarne gli elementi in modo da trovare una serie divergente a

. Per

questo sommiamo prima i termini di indice pari, fino ad un certo indice

tale

che

Questa è la somma parziale

della serie riordinata. Sottraiamo quindi il primo termine di indice dispari, ossia

ottenendo una

somma parziale

tale che

Consideriamo ora la serie (1.11) con .

Come si è detto, questa serie diverge. Dunque, possiamo

sommare ulteriori termini di indice pari alla somma parziale

già ottenuta, fino a trovare una somma parziale maggiore di

;

sottraiamo quindi il primo dei termini di ordine dispari non ancora usati (che è

, minore di

). Si trova una nuova

somma parziale, diciamo ,

maggiore di :

Continuiamo a sommare termini di indice pari (e quindi positivi) fino ad avere una somma parziale

maggiore di

e quindi sottraiamo il primo termine di indice dispari non usato (che è certamente minore

di , infatti è

). Si trova una

somma parziale

tale che

Procedendo in questo modo si trova un riordinamento che conduce ad una serie

divergente a . _

Si potrebbe mostrare che per ogni scelta di

è

possibile riordinare la serie di Mengoli in modo tale da trovare una serie convergente ad

, inclusi

ed

,

o anche in modo da trovare una serie oscillante. Diciamo che una

serie converge incondizionatamente quando una serie converge ad

e inoltre

quando qualunque serie ottenuta riordinandone gli elementi converge al medesimo

numero .

La convergenza incondizionata si caratterizza come segue:

Teorema 31 (Teorema di Dirichlet) Una serie converge incondizionatamente

se e solo se converge assolutamente. Se ciò non accade è possibile riordinare

gli elementi della serie in modo da cambiare il carattere della serie, e anche in

modo da ottenere una serie convergente ad un qualsiasi numero assegnato, o

divergente a

oppure a .

In particolare:

Corollario 32 Ogni serie a termini di segno costante converge

incondizionatamente.

1.5.1 Serie dipendenti da un parametro e serie di funzioni

Torniamo a considerare la serie geometrica,

Questa serie dipende dal parametro

e, come si è visto, converge se ,

diverge se ed oscilla

se . Facendo variare

il parametro ,

ciascuno degli addendi viene ad essere una funzione di

,

Dunque, la serie geometrica può intendersi come serie di funzioni. In generale, data la

successione

i cui elementi sono funzioni (tutte con lo stesso dominio) si chiama serie di funzioni

la serie

La somma della serie si calcola punto per punto; ossia, per ogni fissato valore di

si calcola la somma della

serie di numeri . Il dominio

comune alle funzioni

è ,

ma abbiamo notato che la serie geometrica converge (ad

) soltanto

per .

Dunque, in generale, il dominio su cui è definita la somma di una serie di funzioni

è più piccolo del dominio comune delle funzioni. Le serie di funzioni si studieranno

al Capitolo 2. Va tenuta presente la loro definizione per capire alcune sottigliezze

del paragrafo 1.6.

1.6 Operazioni algebriche e serie

Il concetto di “serie” estende quello di “somma finita”. Le somme finite godono di

utili proprietà, come per esempio la proprietà distributiva del prodotto sulla

somma, la proprietà associativa e “dissociativa”. Ci possiamo chiedere se le

analoghe proprietà valgono per le serie. Per questo dobbiamo tener conto di due

problemi:

- la “somma di somme finite” non dipende dall’ordine degli addendi:

Si sa già che la somma della serie varia cambiando l’ordine dei suoi

termini. Quindi dovremo aspettarci che una proprietà analoga non valga

necessariamente per le serie.

- la somma di serie è definita tramite il concetto di limite; le relazioni tra

limiti ed operazioni sono dissimmetriche. Di ciò dobbiamo tener conto per

enunciare i risultati relativi alle serie.

Queste osservazioni suggeriscono di elencare prima le relazioni tra limiti ed operazioni

sia nella versione “giusta” che nella versione “sbagliata”:

Ricordiamo brevemente perché le affermazioni a destra sono sbagliate: per esempio

nel caso 1, il limite della somma di due funzioni può esistere, senza che le due

funzioni individualmente abbiano limite, come è il caso del limite, per

,

quando le due funzioni sono

In questo caso,

Questo limite non è uguale a

per la semplice ragione che i due limiti non esistono. Il caso 2, del prodotto è

analogo. Vale la pena però di vedre un caso banale che però può inndurre in

errore nel caso delle serie: NON è vero che la formula seguente vale per OGNI numero

reale :

Questa formula vale solo se

oppure se

esiste finito, come mostrano gli esempi delle funzioni

In ambedue i casi, se ,

mentre le espressioni

non hanno senso. Vediamo ora il caso 3a. Chiaramente, da

non si può dedurre la

convergenza a zero di :

si consideri il caso

ed .

Il caso 3b: si consideri l’esempio della successione

con

, convergente

ad , mentre

. La

successione

è oscillante. Richiamato ció, definiamo:

Somma di serie

Prodotto di una serie per un numero

In queste definizioni, l’ordine degli addendi è quello indicato. Supponiamo

Allora:

-

- 1) somma di serie. Vale

purché uno almeno dei due limiti sia un numero oppure sia

che

siano ambedue

oppure .

-

- 2) prodotto di un numero per una serie. La definizione ha senso (e

l’uguaglianza vale) solo se

oppure se la serie converge.

La definizione di prodotto di serie è più complessa e si vedrà nel paragrafo 1.7. Si

potrebbe anche provare:

Teorema 33 Sia

e sia

per ogni .

Sia

una successione limitata. Allora, la serie

converge.

Gli esempi seguenti mostrano i problemi che si possono incontrare usando le operazioni

sulle serie senza le dovute cautele:

Esempio 34 Consideriamo la serie seguente:

Ovviamente la somma della serie è .

Scrivendo

si potrebbe essere tentati di usare una specie di “regola dello scomponendo”

e scrivere

Ovviamente questo non ha senso, perché le due serie a destra non convergono;

e quindi non definiscono numeri che si possano sommare. Un esempio analogo,

un po’ più riposto, è quello delle serie

Le due serie non convergono mentre la serie

converge. _

La regula del prodotto sembra “più innocua” nel senso che sembra più diffcile

sbagliare. In realtà anche questa regola è fonte di errori, come mostra l’esempio

seguente:

Esempio 35 Sia

un parametro reale. Studiare la convergenza della serie

|

| (1.12) |

Si lascia per esercizio di provare che la serie converge per ogni

. Si noti che essa

certamente converge per

perché in tal caso tutti i termini della serie sono nulli. Però, sembra del tutto naturale mettere

in evidenza

portandolo fuori dal segno di serie, scrivendo

e magari studiando la convergenza della serie “piú semplice”

Si dimentica in questo modo che il parametro

può essere nullo. Se

questa serie converge e il procedimento seguito, di mettere in evidenza ,

è corretto. Se però ,

l’ultima serie scritta non converge, mentre la (1.12) ovviamente converge.

L’errore è consistito nel “mettere in evidenza” il fattore

dai termini della serie, errore favorito dal fatto che il fattore è stato indicato

col generico simbolo .

_

Ci sono anche altri errori nei quali si può cadere trattando le operazioni sulle serie

senza la dovuta attenzione:

Esempio 36 Un modo veloce di “calcolare” la somma della serie geometrica

è il seguente:

Dunque,

Questo risultato, apparentemente giusto, è in realtà sbagliato. Infatti da

nessuna parte si è usata la condizione

e quindi sembrerebbe da questo calcolo che la serie geometrica converga per

ogni valore di ,

cosa notoriamente falsa. Si lascia per esercizio di trovare l’errore in questo

ragionamento. _

Infine, vediamo una diversa dimostrazione del Teorema 26 basata sulle proprietà illustrate in questo paragrafo:

La serie

è una serie a termini positivi. Se essa converge, dal teorema 15 convergono anche le due serie

e

,

con

Quindi, per il teorema 16, converge anche

che è .

1.7 Prodotto alla Cauchy

Il prodotto di serie può definirsi in vari modi. Quello più utile è il prodotto alla

Cauchy L’espressione del prodotto alla Cauchy può sembrare macchinosa,

ma se ne capisce la ragione se si considera l’esempio di un prodotto di

polinomi. Consideriamo il caso del prodotto di due polinomi di grado

. Il

prodotto

è la somma di tutti i possibili addendi

con

,

.

Raccogliendo i coeffcienti degli addendi del medesimo grado il prodotto si scrive

come

|

|

Posto ,

il prodotto

si trova scritto come segue:

|

|

Ciò suggerisce le due definizioni seguenti:

- Si chiama convoluzione delle due successioni

e

la successione

con

- Si chiama prodotto alla Cauchy delle due serie

|

| (1.13) |

la serie

Osservazione 37 Se l’indice di una, o ambedue, le serie non parte da zero,

la formula del prodotto alla Cauchy si intende scritta aggiungendo un numero

finito di termini tutti nulli, in modo da far partire gli indici da . _

La convergenza di ambedue le serie (1.13) non implica la convergenza del loro prodotto

alla Cauchy. Vale invece:

Teorema 38 Le due serie (1.13) convergano, ed abbiano somma rispettivamente

e

.

Allora:

- se le due serie convergono ambedue assolutamente, anche il loro prodotto

alla Cauchy converge assolutamente ad .

- se una delle due serie converge e l’altra converge assolutamente, il prodotto

alla Cauchy converge ad ,

in generale non assolutamente.

Concludiamo con un esempio che mostra due serie convergenti (non

assolutamente), il cui prodotto alla Cauchy non converge.

Esempio 39 Consideriamo la serie (convergente per il criterio di Leibniz)

e calcoliamone il prodotto alla Cauchy con se stessa. Notiamo che l’indice di

questa serie parte da

invece che da zero e quindi la formula del prodotto alla Cauchy va lievemente

modificata come detto nell’sservazione 37:

Si vede facilmente che la funzione

è crescente per

e decrescente per

e quindi ha minimo per

e per .

Il minimo vale .

Dunque

il termine generale del prodotto alla Cauchy non converge a zero e quindi la

serie ottenuta come prodotto alla Cauchy non converge. _

1.8 Appendici

1.8.1 Appendice: ancora sul test di MacLaurin

Il test di MacLaurin può ulteriormente precisarsi notando che la (1.8),

ossia

si può anche scrivere come

e che, al crescere di ,

la successione

decresce. e quindi ammette limite compreso tra

ed

.

Infatti, si ha:

|

|

Ossia, al crescere di ,

i valori delle somme parziali e dell’integrale “si avvicinano” anche se l’integrale

improprio (e quindi anche la serie) diverge. Quest’osservazione può usarsi per

ottenere “stime asintotiche” delle somme parziali della serie per grandi valori di

.

Mostriamo questo considerando l’esempio della serie armonica. Sia

La serie armonica è

e quindi diverge, dal criterio di MacLaurin. E’ questo un modo di vedere che la

serie armonica diverge, diverso da quello visto all’esempio 1.5. Però, il criterio di

MacLaurin dà un’informazione in più:

ossia

E inoltre,

esiste, . Il

numero

così definito si chiama costante d’Eulero

1.8.2 La dimostrazione del Teorema di Leibniz

La dimostrazione di questo teorema, e di teoremi più generali di Abel e di Dirichlet

che ora vedremo, è interessante perché permette di introdurre il concetto di

sommazione per parti, da confrontare con quello di integrazione per parti. Nonostante

che il carattere di una serie non dipenda dai primi addendi, in quest’appendice è

bene specificare con cura i valori degli indici. Quindi scriveremo per esempio

per intendere che il valore del primo indice della successione è

. Inoltre, se

indica una

successione, con

intendiamo la successione delle sue somme parziali:

Sia una successione.

Con intendiamo

la successione .

Sia .

La formula di sommazione per parti è:

Questa formula si dimostra facilmente scrivendo la somma per esteso:

|

|

Ci serve inoltre un risultato preliminare:

Lemma 40 Sia

una serie tale che la successione

delle somme parziali sia limitata e sia

una successione positiva decrescente. Allora, la serie

converge assolutamente.

Dim. Si noti che la successione

è convergente, ,

per il teorema della funzione monotona, e quindi limitata. Anzi,

Inoltre, .

L’asserto del lemma segue perché ora proviamo che

.

Infatti,

Osservazione 41 Si noti che il Lemma 40 non richiede la convergenza della

serie . _

Consideriamo ora la serie

e notiamo che

Introducendo i numeri

definiti da

e usando la regola di sommazione per parti con primo indice

, le

sue somme parziali si rappresentano come segue:

|

|

Dunque, per garantire la convergenza della serie

,

basta dare condizioni che garantiscano l’esistenza dei due limiti

|

| (1.15) |

Un criterio per questo è dato dal Teorema di Dirichlet, che immediatamente

implica il criterio di Leibniz:

Teorema 42 (Teorema di Dirichlet) Sia

una successione a valori positivi, decrescente e convergente a zero. Sia

una serie tale che

rimane limitata. Allora, la serie

converge.

Dim. Infatti, il limite (1.14) è nullo perché

è limitata e

. Il limite (1.15)

esiste per il Lemma 40. _ Dimostrazione del criterio di convergenza di Leibniz.

La dimostrazione del criterio di Leibniz per la serie a segni alterni

con

decrescente e convergente a zero, segue immediatamente: basta definire

e

e

notare che

e quindi

rimane limitata. Una diversa condizione per l’esistenza dei due limiti (1.14)

e (1.15) è data dal teorema seguente:

Teorema 43 (Teorema di Abel) Sia

una successione a valori positivi e decrescente. Sia

una serie convergente. Allora, la serie

converge.

Dim. Per ipotesi, esistono ambedue i limiti

e

. Dunque, esiste il

limite (1.14). La successione ,

essendo convergente è anche limitata e quindi il limite (1.15) esiste per il

Lemma 40. _

Capitolo 2

Successioni e serie di funzioni

In questo capitolo studiamo le successioni e le serie di funzioni.

Studiamo quindi particolari metodi per approssimare una data funzione

mediante serie i cui termini sono funzioni elementari: monomi o funzioni

trigonometriche.

2.1 Introduzione

Ricordiamo, dal Par. 1.5.1, che una successione di funzioni è una trasformazione che ad ogni numero

naturale associa una

funzione definita

su un dominio ,

lo stesso per ogni .

Stando così le cose, il problema della convergenza della successione di funzioni si studia per

ogni fissato ;

ossia si studia una successione numerica per ogni valore del parametro

. Se la succesisone

converge a

per ogni

, si dice che la

successione converge

puntualmente ad

su . In

realtà questo è un modo piuttosto semplicistico di procedere. Le

applicazioni richiedono infatti di studiare la convergenza rispetto ad

opportuni concetti di “distanza” tra funzioni. Ciò è quanto facciamo

in questo capitolo. Notazione. Da ora in poi di regola useremo una

notazione meno “elementare”: per indicare una funzione invece di scrivere

scriveremo semplicemente

. Invece, col simbolo

intenderemo il

valore che la funzione

assume nel punto .

In certi casi questo può condurre ad ambiguità ed allora useremo notazioni del tipo

per indicare la

funzione che ad

associa . Va detto

che la notazione

non si può usare per specifiche funzioni: la funzione

si indicherà

semplicemente con .

Dunque, successioni e serie di funzioni di regola si indicheranno con la

notazione

ecc. Invece scriveremo esplicitamente

quando dovremo considerare successioni o serie di funzioni particolari, per

esempio

2.2 Distanze tra funzioni

Noi considereremo funzioni definite su un fissato insieme

che

sarà sempre un intervallo. Specificheremo volta per volta se tale intervallo deve essere

limitato e/o chiuso. Inoltre, non considereremo tutte le possibili funzioni definite su

, ma

le funzioni di una delle tre classi seguenti:

- col simbolo

si intende l’insieme delle funzioni continue su .

Implicitamente usando questo simbolo si intende che

sia limitato e chiuso, .

- col simbolo

si intende l’insieme delle funzioni il cui valore assoluto è integrabile su

:

L’insieme

è ora un intervallo qualsiasi.

- col simbolo ,

si intende l’insieme delle funzioni tali che

L’insieme

è ora un intervallo qualsiasi. Si noti la presenza del segno

e del quadrato. Ovviamente, se la funzione prende valori reali, .

Però molto spesso la funzione

prende valori complessi e in tal caso il segno di modulo è necessario.

Osservazione 44 L’integrale che usiamo è l’integrale di Riemann. Si

ricordi che una funzione integrabile secondo Riemann è necessariamente

limitata. Usando questa proprietà, si potrebbe mostrare che, se l’intervallo

è limitato, i due insiemi

ed

hanno i medesimi elementi. I due insiemi invece sono diversi se

è illimitato o se si usano concetti diversi di integrale, che permettono di

integrare anche funzioni illimitate. A noi interessa sapere che:

I tre insiemi sopra definiti sono spazi lineari, nel senso visto nei corsi di geometria,

rispetto alle operazioni

In questi spazi lineari si introduce una distanza come segue:

- in

si pone

(si noti che il massimo esiste, dal teorema di Weierstrass, perché

l’intervallo

è limitato e chiuso.) La distanza sopra definita si indica anche col simbolo

- Le distanze in

e in

si indicano anche, rispettivamente, con i simboli

e sono definite da

Si noti che in questi simboli l’intervallo

è sottinteso e che spesso si scrive, rispettivamente,

usando il simbolo di “norma della differenza”, al posto di quello di distanza

Osservazione 45 Non ci serve essere precisi su questo. Però va detto che

solamente la norma

è effettivamente una norma e che solo

è effettivamente una distanza. Infatti, se ,

se

per ogni

e se

per

mentre ,

allora ,

nonostante che

e

siano tra loro diverse. _

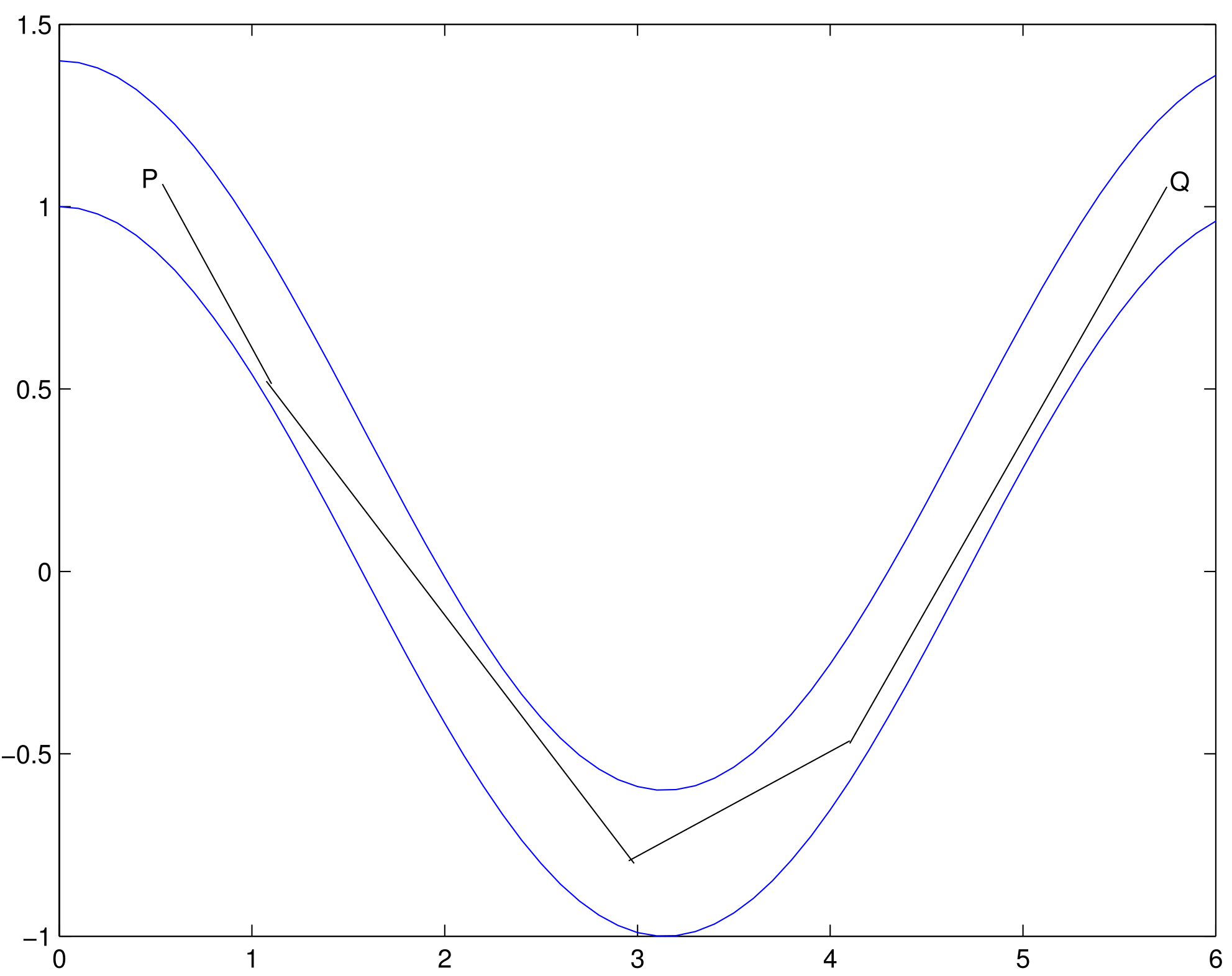

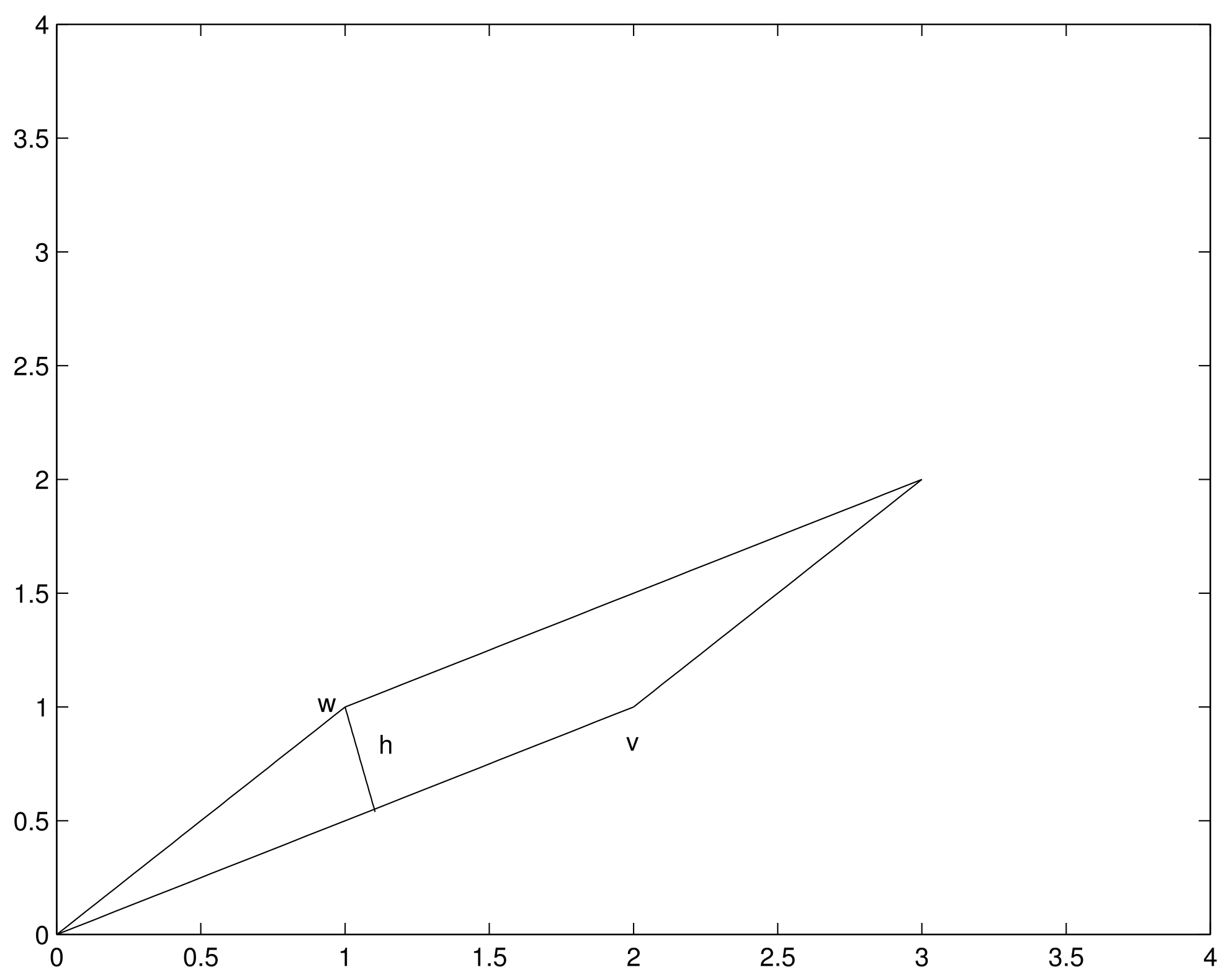

Accade che

quando il grafico di

sta in un “tubo” di ampiezza

intorno a quello di ,

come in figura 2.1. Si noti che il “tubo” può essere disegnato intorno ad una

qualsiasi delle due funzioni. Ciò fatto si richiederà che il grafico dell’altra

stia in tale “tubo”.

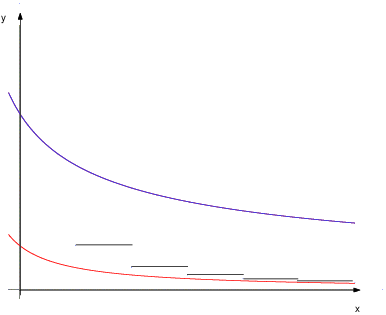

Invece, quando

accade che è minore di

l’area del trapezoide di ,

ossia l’area della superficie compresa tra i grafici delle due

funzioni. La figura 2.2, a sinistra, riporta il grafico di

ed a destra quello

di (per le medesime

due funzioni

e )

con tratteggiata la regione la cui area deve essere “piccola”

se si vuole che queste “distino di poco” rispettivamente in

ed in

. La figura suggerisce che

la distanza, nel senso ,

o , tra due

funzioni possa essere “piccola” anche se i due grafici diventano “molto distanti” per certi

valori di .

Scriviamo ora esplicitamente la definizione di convergenza rispetto alla distanza

.

Questo tipo di convergenza si chiama convergenza uniforme

La successione di funzioni

converge uniformemente ad

su

se per ogni

esiste

tale che

per ogni

vale

ossia, per

vale

Per contrasto, diamo la definizione di convergenza puntuale: la successione

converge

puntualmente ad

su quando per

ogni e per ogni

esiste un numero

tale che se

si ha, per questo

particolare numero ,

. Cambiando il

punto cambia

anche il numero .

Si ha convergenza uniforme quando si può trovare un numero

che va bene per ogni

. Diamo ora la definizione

di convergenza in

ed in .

La successione

converge ad

in

se per ogni

esiste

tale che

per ogni

si ha

La successione

converge ad

in

se per ogni

esiste

tale che

per ogni

si ha

La convergenza in

si chiama anche convergenza in media e la convergenza in

si chiama

anche convergenza in media quadratica mentre, come si è già detto, la convergenza

in si

chiama convergenza uniforme.

Osservazione 46 Supponiamo che la successione di funzioni

sia definita su un dominio ,

.

Se la successione converge uniformemente su ,

essa converge uniformemente sia su

che su

e, viceversa, se la successione converge uniformemente su

e anche su ,

essa converge uniformemente anche su .

Asserto analogo vale anche per la convergenze in media e per la convergenze

in media quadratica. _

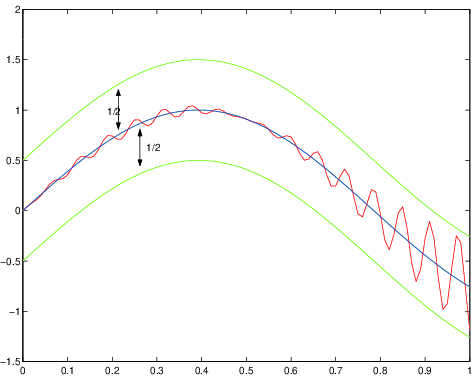

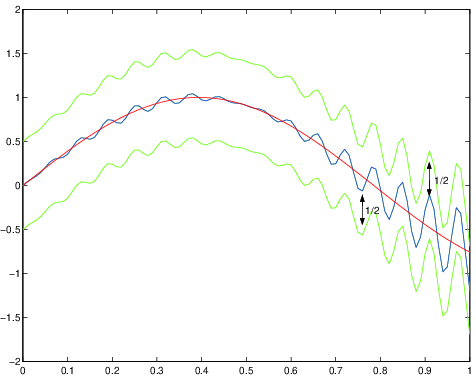

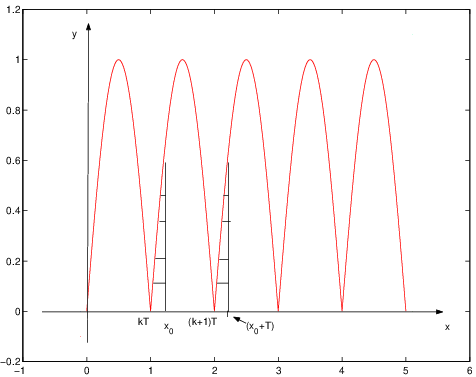

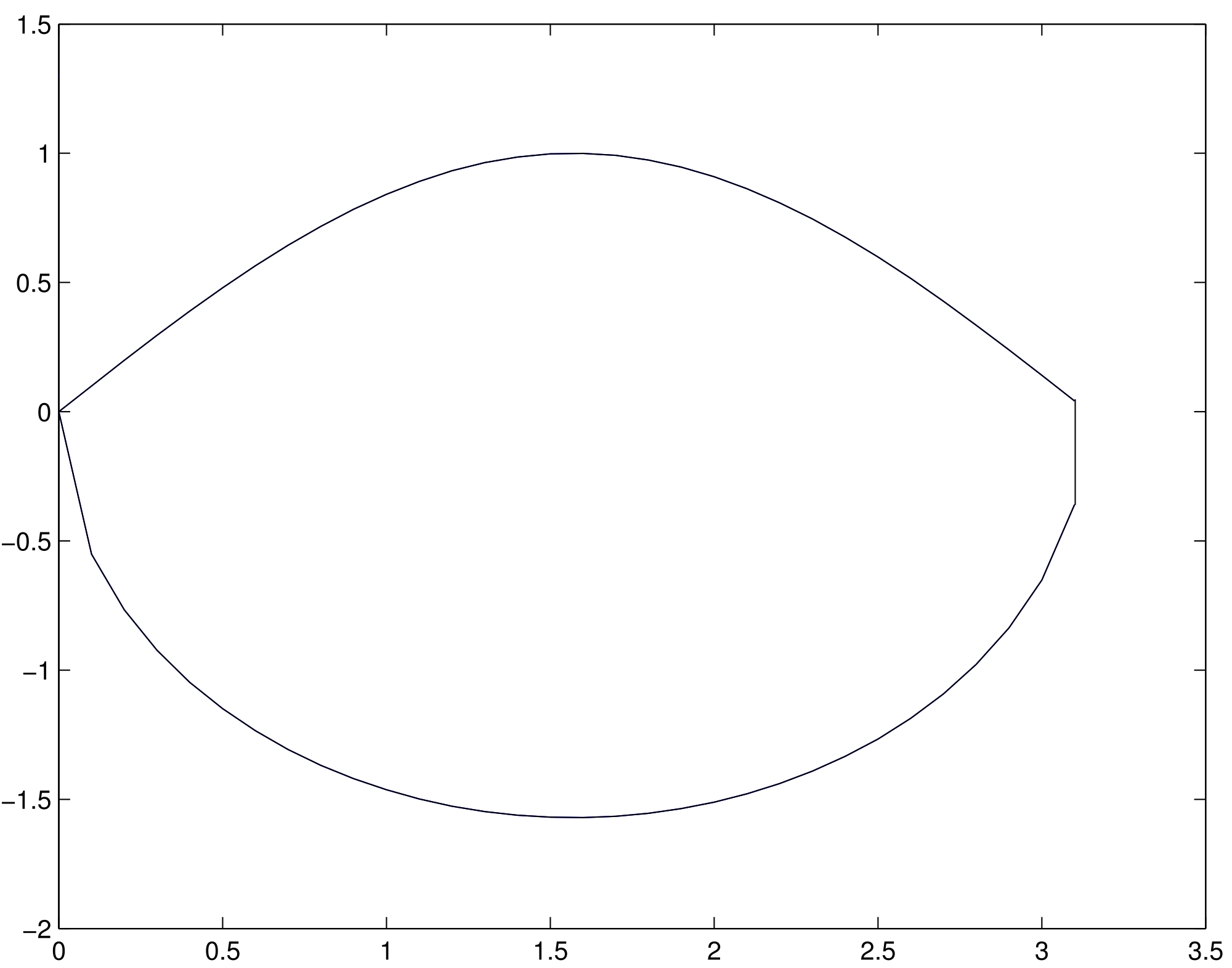

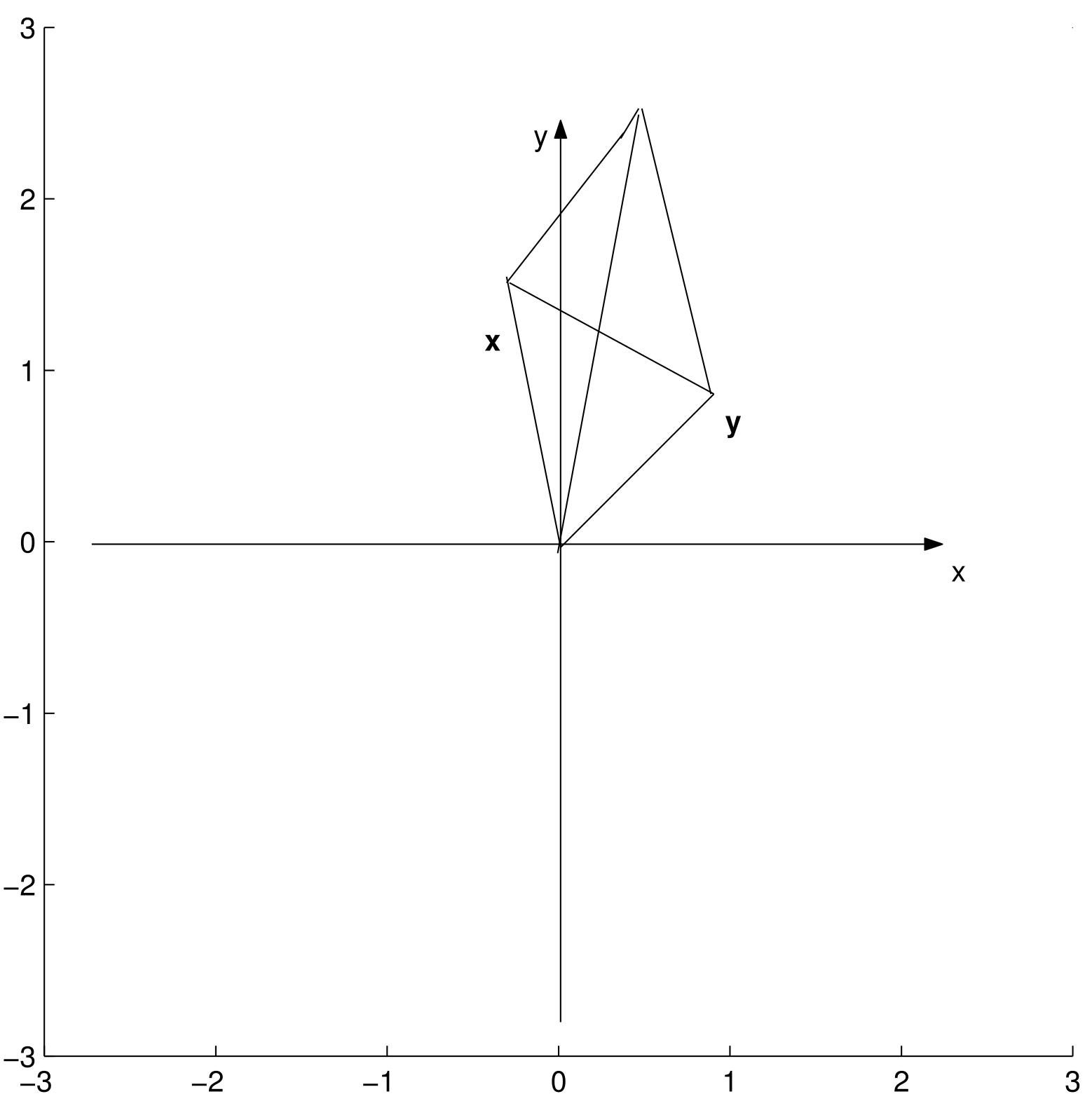

Vediamo ora due figure che illustrano il significato della convergenza uniforme e

della convergenza in media. La fig. 2.3 a sinistra suggerisce la convergenza

uniforme. La figura a destra vuol suggerire la convergenza in media, e

vuol sottolineare che la convergenza in media non implica la convergenza

puntuale. I grafici rappresentati a destra sono quelli delle funzioni

con ,

,

,

.

Si provi dettagliatamente, facendo uso della definizione, che la successione

,

,

converge a zero in media ed in media quadratica, ma non uniformemente.

Infine, enunciamo il lemma seguente, immediata conseguenza del teorema di

confronto per i limiti. La dimostrazione è lasciata per esercizio.

Lemma 47 Sia

una successione di funzioni su un intervallo .

Su tale intervallo sia anche definita una funzione .

Sia

una successione numerica tale che

- se vale

allora la successione

converge uniformemente a .

- se vale

allora la successione

converge a

in .

- se vale

allora la successione

converge a

in .

2.2.1 Il prodotto interno su

Su si

può definire un prodotto interno o prodotto integrale come segue: siano

e

due funzioni a quadrato integrabile. Si può provare che il loro prodotto

è integrabile. Definiamo allora il prodotto interno delle due funzioni

e

ponendo

Si noti che se le funzioni prendono valori reali allora il segno di coniugio non ha

alcun effetto; se però esse prendono valori complessi il coniugio è importante

perché è grazie ad esso che si ottiene

Quest’uguaglianza giustifica il termine “prodotto interno”

(o “prodotto scalare”): nel caso dei “vettori ordinari” di

si ha

infatti

Diciamo che due funzioni

e sono

ortogonali in

quando

Naturalmente, per dire che

è ortogonale a ,

scriveremo

Una proprietà importante del prodotto interno in

è

che per esso vale il teorema di Pitagora:

Teorema 48 Se

allora .

Dim. Infatti si ha

In particolare,

Osservazione 49 Va notato esplicitamente che non esiste nessun concetto

analogo a quello di prodotto interno per le distanze in

o di . _

2.2.2 Proprietà della convergenza uniforme

La sola convergenza puntuale è troppo debole per avere proprietà importanti di

qualche tipo. Infatti:

- esistono successioni di funzioni integrabili che convergono puntualmente

a funzioni non integrabili.

Per vedere un esempio, ricordiamo che i numeri razionali sono

numerabili, ossia sono immagine di una successione iniettiva. Sia

questa successione e definiamo la funzione

Ciascuna delle funzioni

è integrabile, con integrale uguale a zero, perché

è zero salvo che in un numero finito di punti. La successione

converge alla funzione

di Dirichlet, che vale

sui razionali e vale

sugli irrazionali. Questa funzione non è integrabile.

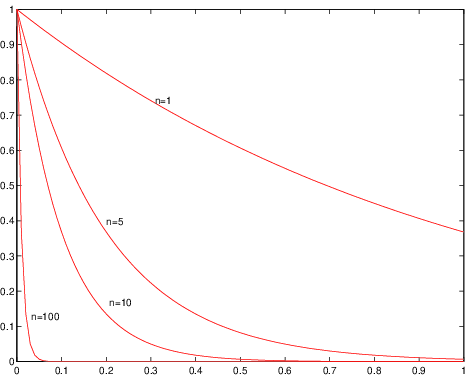

- esistono successioni di funzioni continue che convergono puntualmente a

funzioni discontinue.

Un esempio è il seguente: sia

e sia .

Ciascuna funzione è continua, ma la successione di funzioni

converge

puntualmente su

alla funzione

Questa funzione è discontinua. E’ per questa ragione che vanno introdotti

concetti più restrittivi di convergenza. In questo paragrafo presentiamo le relazioni

tra il concetto di convergenza uniforme e le proprietà di limite, derivabilità ed

integrazione.

Il teorema centrale è il seguente:

Teorema 50 Sia

una successione di funzioni, definite su un intervallo ,

ciascuna delle quali è continua in un punto .

Se la successione converge ad una funzione

uniformemente su

allora anche la funzione

è continua in .

Omettiamo la dimostrazione. Ricordando che le funzioni continue su un intervallo

limitato e chiuso sono integrabili si ha:

Corollario 51 Sia

una successione di funzioni continue su un intervallo limitato e chiuso .

La successione converga uniformemente su

ad una funzione .

Allora, la funzione

è continua e quindi anche integrabile su .

Sotto le ipotesi del corollario precedente, può dirsi di più: l’integrale di

è il limite degli

integrali delle .

Ossia:

Teorema 52 Sia

una successione di funzioni continue su un intervallo limitato e chiuso

. La successione converga

uniformemente su

ad una funzione .

Allora,

|

| (2.1) |

Dim. Ricordando la definizione di limite, dobbiamo provare che per ogni

esiste

tale che

per ogni

si ha

Dalla linearità e dalla proprietà di monotonia degli integrali,

e quindi basta provare che

per

suffcientemente grande. Ricordiamo che la successione

converge ad

uniformemente

su : scelto un

qualunque

esiste tale

che, per ogni

si ha

e quindi anche

con la lunghezza

di . L’asserto

segue scegliendo

e . _

Osservazione 53 Ricordiamo, dall’Osservazione 46, che se

e se la successione

converge uniformemente su ,

essa converge uniformemente sia su

che su .

D’altra parte, l’integrale su

è la somma dei due integrali su

e su .

Quindi il teorema si applica facilmente anche a successioni uniformemente

convergenti di funzioni continue a tratti e questo è suffciente per molte

applicazioni. Si potrebbe però provare che la semplice integrabilità di ciascuna

delle funzioni

e la convergenza uniforme della successione ad

implica che la

è integrabile e che vale l’uguaglianza (2.1). _

Sia primitiva di

. La convergenza

della successione

non implica la convergenza della successione

. Questo si vede

facilmente scegliendo

per ogni ,

ed per

ogni .

Le cose cambiano se si assegna il comportamento che le

devono avere in un

medesimo punto :

Teorema 54 Sia

una successione di funzioni continue su un intervallo

e sia

Supponiamo che

e che la successione

converga uniformemente ad .

In tal caso la successione

converge uniformemente alla funzione

Dim. Ricordiamo che la funzione

è continua, come limite uniforme di una successione di funzioni continue. Dunque l’espressione

proposta per ha

senso. La differenza

si stima così:

La successione numerica

tende a zero per ipotesi, mentre la successione numerica

tende a zero per il Teorema 52. L’asserto segue quindi dal Lemma 47. _ Vediamo

ora le relazioni tra derivazione e convergenza uniforme. E’ facile trovare esempi che

mostrano che il limite uniforme di una successione di funzioni derivabili può non essere

derivabile.

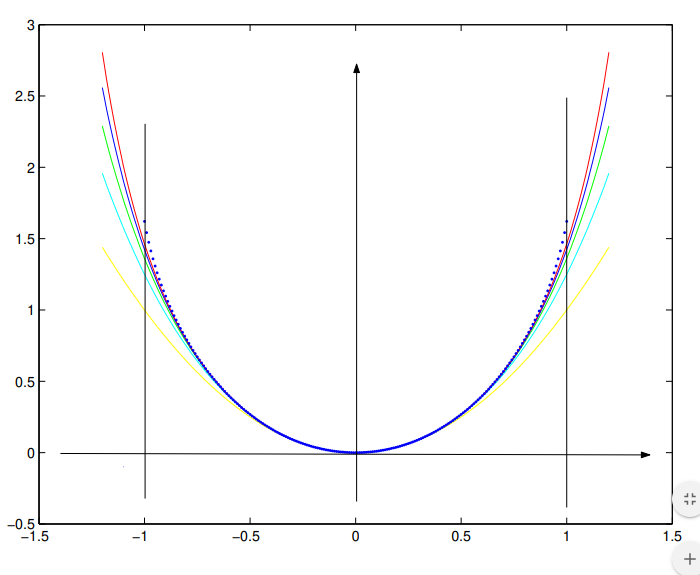

Esempio 55 Consideriamo la successione di funzioni

Ciascuna di queste funzioni è derivabile ma la successione

di funzioni converge uniformemente alla funzione non derivabile

.

Il grafico di alcune di queste funzioni è in figura 2.4. _

Vale però:

Teorema 56 Sia

una successione di funzioni derivabili su un intervallo

.

Supponiamo che:

- esista un punto

tale che la successione numerica

converga;

- la successione

converga uniformemente su

ad una funzione .

In tal caso la successione

converge uniformemente su

ad una funzione che è

derivabile, ed inoltre ;

ossia

Dim. Per ipotesi,

L’asserto segue quindi dal Teorema 54. _

2.3 Serie di funzioni

Le serie di funzioni si definiscono in modo del tutto analogo alle serie numeriche: se

é

una successione di funzioni, la serie corrispondente si indica col simbolo

Se é necessario indicare i valori presi dall’indice scriveremo per esempio

Il significato del simbolo di serie é il seguente: supponendo che l’indice prenda tutti i valori

maggiori od uguali a ,

si costruisce la nuova successione

Se la successione di funzioni

converge uniformemente, si dice che la serie converge uniformemente; se la successione di

funzioni

converge in

oppure in ,

si dice che la serie converge in tal senso. Enunciamo il teorema seguente, senza

dimostrarlo:

Teorema 57 Sia convergente la serie di numeri positivi

Valga inoltre

ove

oppure oppure

.

Sotto queste ipotesi, esiste una funzione

(rispettivamente in ,

oppure )

tale che la serie

converge nel senso corrispondente a .

Sia

una serie di funzioni. Si dice che questa serie converge normalmente (in

oppure

in )

quando converge la serie

(con

uguale a ,

).

L’asserto del teorema precedente si esprime anche dicendo che una serie che converge

normalmente è anche una serie convergente. Il viceversa non vale. Nel caso di

, ossia

per la convergenza uniforme, il test per la convergenza dato nel Teorema 57 si

chiama anche test di Weierstrass A parte questo teorema, di dimostrazione diffcile,

i teoremi visti per la convergenza delle successioni di funzioni si adattano

facilmente allo studio della convergenza delle serie. Enunciamo in particolare:

Teorema 58 Una serie di funzioni continue

converga uniformemente su

ad una funzione .

Allora la funzione

è continua e, se

è limitato e chiuso, vale

Sia

una successione di funzioni derivabili, convergente puntualmente su

ad una funzione .

Supponiamo che la serie

converga uniformemente su

ad una funzione .

Allora la funzione

è derivabile, con derivata

ed inoltre la serie

converge ad

uniformemente su .

Esempio 59 Consideriamo la serie

Questa serie converge puntualmente su .

ossia converge per ogni .

Infatti, se

ogni termine della serie è nullo e quindi la somma della serie è ;

se

allora è lecito scrivere

Dunque, si ha

Dunque la somma della serie non è continua e quindi la serie, pur convergendo

puntualmente su ,

non converge uniformemente. _

2.4 Serie di potenze

Si chiamano serie di potenze le serie di funzioni della forma

|

| (2.2) |

ottenute a partire dalla successione di monomi

. Si noti che il primo

valore dell’indice è ora

ma niente vieta che sia

ossia che la serie “parta” per esempio con indice

. Se esiste

tale che

per

, allora la

serie di potenze si riduce ad un polinomio: le serie di potenze generalizzano i polinomi. Il

numero

si chiama il centro della serie e la serie di potenze converge sempre per

(e ivi

converge ad ).

Potrebbe non convergere in nessun altro punto.

Esempio 60 Si consideri la serie seguente, di centro :

Si fissi il valore di

e sia

tale che .

Allora, per ,

si ha

Dunque, se ,

il termine generale della serie non tende a zero, e quindi la serie non converge. _

Vale però:

Teorema 61 (Teorema di Abel) Una serie di potenze converga in un

punto

e sia

Allora, la serie di potenze converge uniformemente in

per ogni .

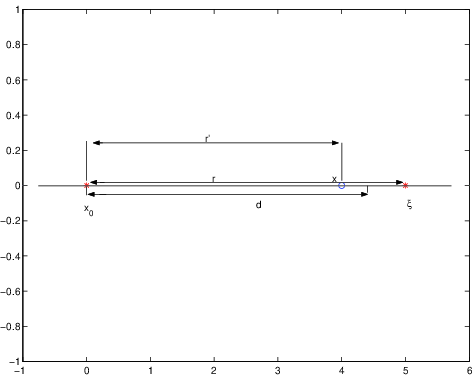

Dim. Si guardi la figura 2.5 per seguire questa dimostrazione.

Sia e

sia

così che

e quindi

La convergenza in

implica che la successione

è limitata (anzi tende a zero):

Inoltre,

Dunque, per

si ha

con e

quindi con .

La convergenza uniforme segue dal criterio di Weierstrass, Teorema 57. _

Questo risultato in particolare implica che se una serie di potenze

converge allora l’insieme su cui essa converge è un intervallo centrato in

(e non si esclude che

sia ridotto al solo ,

oppure che sia tutta la retta). Questo si chiama l’intervallo di convergenza della serie di

potenze e si chiama raggio di convergenza la sua semiampiezza. Il raggio di convergenza

può essere nullo, si veda l’esempio 60. Può essere un numero finito non nullo oppure

può essere :

è un numero finito non nullo nel caso particolare della serie geometrica, è

nel

caso in cui la serie di potenze si riduca ad un polinomio, ma non solo in tal caso:

Osservazione 62 Consideriamo la serie

fissato ,

si trova una serie numerica, convergente per ogni valore del parametro ,

come si vede facilmente usando il criterio del rapporto. _

Inoltre, la dimostrazione del Teorema 61 mostra che:

Teorema 63 (Teorema di Abel) Sia

il raggio di convergenza di una serie di potenze e sia

tale che .

La serie di potenze converge assolutamente e quindi incondizionatamente nel

punto .

Ciò mostra che l’ordine dei termini di una serie di potenze non influisce sulla somma

della serie nei punti interni all’intervallo di convergenza. Invece, niente può dirsi in

generale del comportamento della serie negli estremi dell’intervallo di convergenza,

come mostrano gli esempi seguenti.

Esempio 64 Consideriamo la serie di potenze

fissato si

trova una serie numerica e si vede facilmente, dal criterio del rapporto, che la sere converge

per ogni con

, diverge se

. Dunque il raggio

di convergenza è .

Se

oppure

si trovano rispettivamente le due serie

La prima divergente e la seconda convergente. Si è detto che la somma di una serie

di potenze non dipende dall’ordine degli elementi nei punti interni dell’intervallo di

convergenza. Quest’esempio mostra che, invece, può dipendere dall’ordine degli elementi

se è

uno degli estremi dell’intervallo di convergenza. Mostriamo ora una serie di potenze

che converge in ambedue gli estremi dell’intervallo di convergenza. La serie è

Di nuovo, fissato ,

si usi il criterio del rapporto per studiare la convergenza della

serie numerica che si ottiene. Si vede che si ha convergenza per

, estremi inclusi, mentre

la serie diverge per .

Infine, mostriamo una serie di potenze che diverge in ambedue gli estremi

dell’intervallo di convergenza. Questa è la serie

Questa è una serie geometrica di ragione

e quindi converge

se e solo se ,

estremi esclusi. Si noti che la somma di questa serie è la funzione

una funzione di classe .

La ragione per cui la serie corrispondente non debba convergere

negli estremi sembra misteriosa, e verrà chiarita al paragrafo 2.4.2.

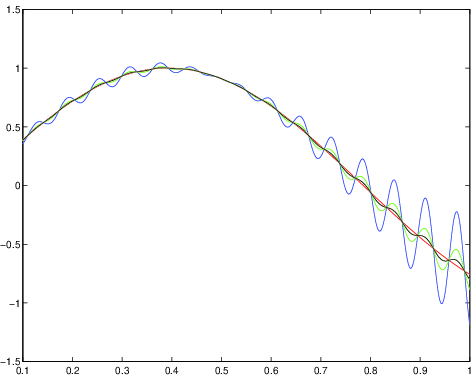

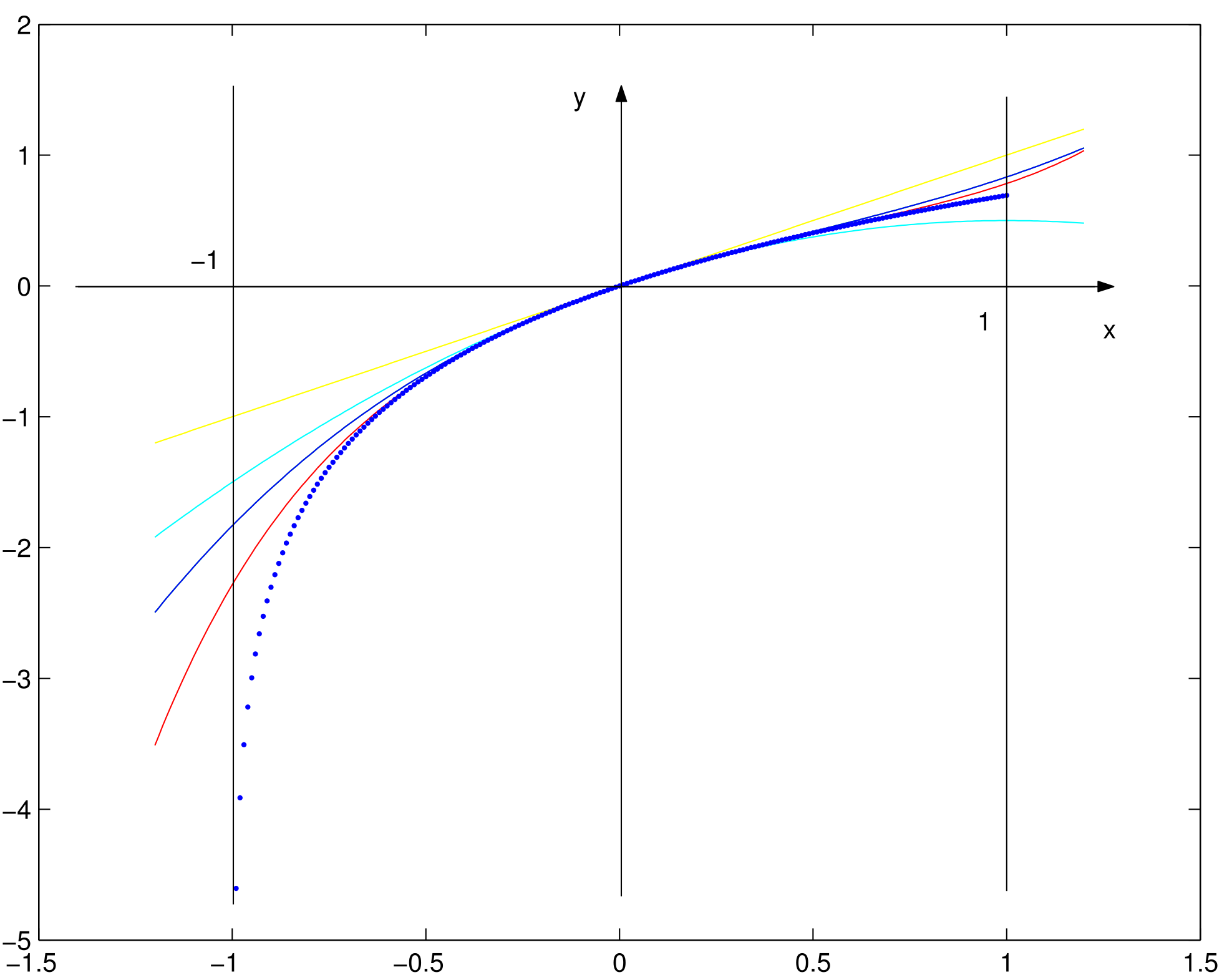

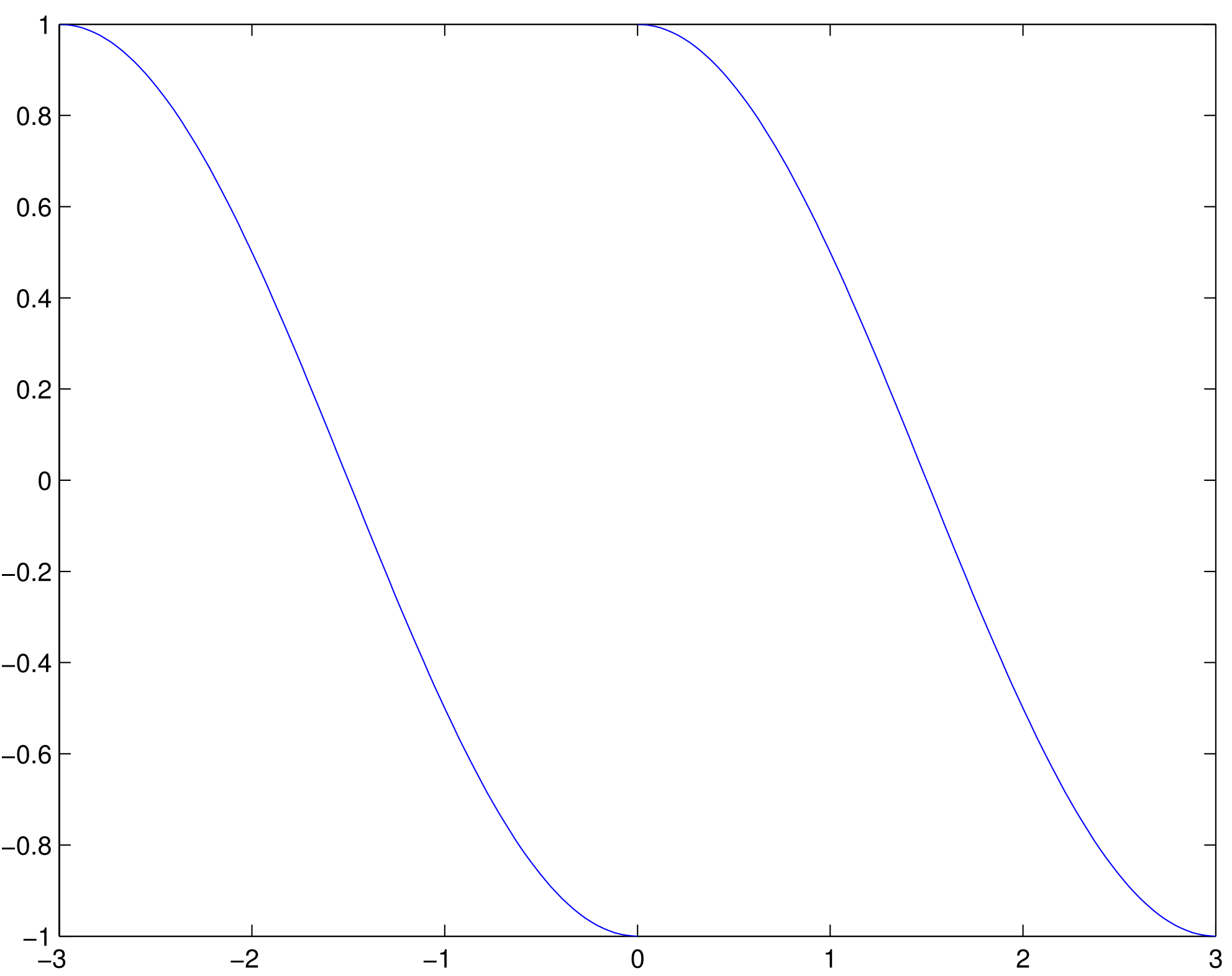

E’ interessante vedere i grafici di alcune delle somme parziali delle

tre serie introdotte sopra. L’intervallo di convergenza delle serie è

.

I grafici delle somme parziali sono disegnati su un intervallo

un po’ più grande e, punteggiato, si riporta anche il

grafico della somma della serie, ovviamente solo sull’intervallo

.

La prima e la seconda serie sono alla figura 2.6

L’ultima serie è alla figura 2.7.

Il grafico punteggiato (tratto spesso) in questo caso rappresenta la funzione

,

che è la somma della serie sul solo intervallo .

E’ stato disegnato in un intervallo più grande per sottolineare che la questa

funzione è regolare anche nei punti

e . _

Inoltre, la convergenza essendo uniforme, dal Teorema 50:

Corollario 65 La somma di una serie di potenze è continua nei punti

interni all’intervallo di convergenza.

Si potrebbe inoltre provare che:

Teorema 66 Sia il raggio

di convergenza della serie .

Le due serie di potenze

|

|

hanno lo stesso raggio di convergenza e questo è uguale ad

.

Le due serie in (2.6) si dicono ottenute derivando termine a termine o integrando

termine a termine la serie data. Esse convergono uniformemente in

e

quindi, usando i teoremi 52 e 56, si trova l’uguaglianza

|

|

In particolare quindi anche la serie derivata può a sua volta venir

derivata termine a termine e ciò tante volte quante si vuole. Dunque:

Corollario 67 La somma di una

serie di potenze di raggio di convergenza non nullo è una funzione di classe

nell’intervallo di convergenza.

Chiediamoci ora come sia possibile calcolare il raggio di convergenza di una serie di

potenze. Esiste una formula per il raggio di convergenza, che non possiamo

presentare. Possiamo però presentare due test particolari, che si ottengono per

confronto con la serie geometrica. Il primo si può applicare quando si ha

per

ogni

(e basta che questa condizione sia soddisfatta per

maggiore di un

opportuno ).

Teorema 68 Supponiamo che

per ogni

e che esista, finito o meno,

Allora il raggio di convergenza della serie è

Dim. Limitiamoci a considerare il caso .

Applichiamo il criterio del rapporto per la convergenza della serie di numeri

con

fissato. Il criterio del rapporto asserisce che condizione suffciente di convergenza è che

per

suffcientemente grande valga

|

| (2.6) |

La serie diverge se vale la disuguaglianza opposta, con

.

Proviamo che si ha convergenza se

In tal caso,

tale che

|

| (2.7) |

Sia .

Il teorema di permanenza del segno mostra l’esistenza di un numero

tale che

per ogni

vale

Essendo ,

la serie converge (si ricordi (2.6)). In modo analogo si trattano gli altri casi. _

Ripetiamo che il teorema precedente non può usarsi se infiniti coeffcienti

sono

nulli. Usando il criterio della radice invece del criterio del rapporto si prova invece:

Teorema 69 Se esiste, finito o meno, il limite

allora il raggio di convergenza è

Si noti che il Teorema 69 può usarsi anche se infiniti coeffcienti

sono

nulli. Mostriamo ora che esistono serie di potenze il cui raggio di convergenza

non può determinarsi né col criterio del rapporto né con quello della

radice

Esempio 70 Si consideri la serie

E’

Quindi,

E’:

e quindi

In casi di questo tipo, conviene considerare

come una parametro e studiare la convergenza della serie numerica ottenuta,

per ogni valore di .

Usando il criterio della radice per ogni

fissato, si vede che

se

e quindi se ,

per qualche .

Dunque il raggio di convergenza è almeno .

D’altra parte, se

allora per ,

pari, si trova

Quindi, il termine generale non tende a zero e la serie non converge. Quindi, il

raggio di convergenza è uguale ad . _

2.4.1 Operazioni sulle serie di potenze

Le operazioni sulle serie di potenze si eseguono con le regole delle

operazioni sulle serie numeriche, per ogni fissato valore del parametro

. Ci

interessa però notare esplicitamente:

Somma di serie Siano ,

due serie di potenze

col medesimo centro

e con raggio di convergenza rispettivamente

ed

.

Sia

Allora, ambedue le serie convergono per

e

quindi la loro somma può scriversi nuovamente come serie di potenze di centro

, convergente

per :

Il raggio di convergenza della serie somma può essere maggiore di

. Per

esempio, se ,

allora la serie somma ha raggio di convergenza

anche se

. Ciò però può

aversi solamente se .

Infatti, se per esempio

allora .

Infatti, scrivendo

si vede che il raggio di convergenza della prima serie è almeno uguale

a

e questo sarebbe maggiore di

se fosse .

L’operazione di somma può usarsi anche “al contrario” per calcolare il raggio di

convergenza in certi casi nei quali falliscono sia il criterio del rapporto che quello

della radice:

Esempio 71 Torniamo a considerare la serie vista all’esempio 70. La serie

di quest’esempio si può vedere come somma delle due serie

Ora, rinominando

l’indice

della prima serie, si trova

Sostituendo

si trova la serie di potenza

a cui si può applicare sia il criterio del rapporto che quello della radice. Il

raggio di convergenza è

per la serie della variabile ,

e quindi

per la serie della variabile .

Analogamente, la seconda serie converge per .

Dunque, il raggio di convergenza della serie somma è esattamente . _

Unicità della serie di potenze Mostriamo che la serie di potenze che converge ad

una funzione ,

se esiste, è unica:

Teorema 72 Siano

due serie di potenze con raggio di convergenza rispettivamente

ed .

Sia .

Se

per ogni

con

allora

per ogni

e quindi .

Dim. Basta provare che se

per allora

. Posto

si trova

infatti e

quindi l’uguaglianza precedente si scrive

Dunque si ha anche

Calcolando per

si vede e

dunque

Il procedimento può quindi ripetersi trovando

, e

così via. _

Prodotto alla Cauchy di serie di Potenze Consideriamo le due serie di potenze col

medesimo centro

Calcoliamo tutti i possibili prodotti di un termine della prima con un termine della

seconda e raccogliamo i coeffcienti dei termini con la medesima potenza

. Si trova

quando si fa il

prodotto di

con tutti i termini della forma

Ossia, il coeffciente di

viene ad essere

Ciò suggerisce la definizione di prodotto alla Cauchy, definito da

E’ appena il caso di notare che il “nome“ degli indici non ha

effetto sulla somma della serie. Si sono usati “nomi” diversi

(,

ed

) solo

per chiarezza. Il teorema che si può provare è il seguente:

Teorema 73 Due serie di potenze abbiamo raggio di convergenza rispettivamente

ed

coan .

La serie prodotto alla Cauchy ha raggio di convergenza almeno uguale ad

.

Osservazione 74 Consideriamo l’esempio seguente:

Il prodotto alla Cauchy contiene potenze

solo se

può scriversi nella forma

per certi valori di

e .

Il coeffciente di questa potenza è la somma di tanti numeri

quanti sono i modi di scrivere

in tale forma. Ma ora,

e il loro prodotto è

Vedremo, al paragrafo 2.4.3, un modo diverso per rappresentare questa

funzione come somma di una serie di potenze, che calcola i coeffcienti della

(unica!) espansione

in serie di potenze facendo derivate. precisamente vedremo che il coeffciente

di

è

In questo modo, dato ,

si calcola facilmente in quanti modi questo si può rappresentare come somma

di tante “monete” di valore

e tante “monete” di valore . _

2.4.2 Serie di potenze nel campo complesso

Le operazioni algebriche e le operazioni di limite possono anche calcolarsi tra numeri complessi.

Quindi, le serie di potenze possono trattarsi anche nel campo complesso. Il Teorema 61 e il

Teorema 63 si riformulano come segue:

Teorema 75 (Teorema di Abel) Una serie di potenze

nel campo complesso, converge sempre nel punto .

Se converge anche in altri punti, allora essa converge in un disco aperto di centro

e raggio

(si scrive

se la serie converge per ogni ).

La convergenza è uniforme in ogni disco di centro

e raggio ;

è assoluta in ciascun punto

interno al disco di convergenza.

Per convergenza assoluta nel caso di serie di potenze a valori complessi, si intende la convergenza della

serie

La dimostrazione è del tutto analoga a quella vista per le serie di potenze reali. Però, ora può mostrarsi

di più: sia

la somma di una serie di potenze di raggio di convergenza

. Esiste almeno

un punto tale

che , nel quale

la funzione

non è regolare. Ciò chiarisce la stranezza notata all’Esempio 64. Per

vale

e la funzione

è di classe .

Non si vede quindi quale fenomeno possa bloccare la convergenza della serie. Se però la serie si

legge nel campo complesso, allora

e la funzione non è

definita nei punti ,

che distano

dal centro della serie.

2.4.3 Serie di Taylor

Sia una funzione

di classe in un

intorno di .

Ad essa può associarsi la serie di Taylor

Questa si chiama la serie di Taylor della funzione

.

Questa serie può non convergere e, se converge, può non convergere alla funzione

, come

mostra l’esempio seguente:

Esempio 76 Sia

Questa funzione è di classe

su

e le sue derivate in

sono tutte nulle. Dunque la serie di Taylor di centro

associata ad

ha tutti i coeffcienti nulli: converge su

alla funzione identicamente zero e non ad . _

Ci possiamo chiedere quindi sotto quali condizioni la serie di Taylor di

effettivamente converga

ad . Scrivendo la

formula di Taylor di

arrestata all’ordine

e col resto in forma di Lagrange, si vede che

dove dipende

da ed è

compreso tra

ed . La serie di

Taylor converge ad

quando il resto converge a zero. Una condizione perché ciò accada è:

Teorema 77 Esistano ,

tali che

La serie di Taylor di

converge su

e converge alla funzione .

Dim. Ricordiamo che per ogni

si ha

Si osservi ora che

Il membro destro tende a zero e quindi, per il criterio del confronto, tende a zero

uniformemente anche l’errore

La condizione del Teorema 77 è soddisfatta nel caso delle funzioni di cui

correntemente si usano gli sviluppi di Taylor, almeno su un opportuno

intervallo. La tabella seguente riporta alcune funzioni e il raggio di convergenza

della relativa serie di McLaurin (ossia, della serie di Taylor di centro

).

Infine, studiamo la relazione tra parità di una funzione e sua serie di Taylor. Vale:

Teorema 78 Sia

f(x) = ∑

n=0+∞a

nxn.

La funzione è pari se e solo se sono nulli i coeffcienti

an

di indice dispari; la funzione è dispari se e solo se sono nulli i coeffcienti

an

di indice pari.

Dim. Sia f(x)

sviluppabile in serie di Taylor. Se è dispari, essa si annulla in

0. Dunque

a0 = 0.

La sua derivata prima è pari ma la derivata seconda è dispari e quindi

f″(0) = 0 ossia vale

anche a2 = 0.

Iterando questo procedimento si vede che ogni

a2k è nullo.

Se f(x) è

pari, sono dispari tutte le sue derivate di ordine dispari e quindi sono nulli gli

a2k+1. Il

viceversa è ovvio. _

2.4.4 Serie di potenze ed equazioni differenziali lineari

Consideriamo il problema di Cauchy

x′ = ax,x(0) = x

0.

Il coeffciente a è costante.

Per definizione, la soluzione x

è continua e quindi, dall’uguaglianza, è addiritture continuamente derivabile; e

quindi

x″ = ax′ = a2x.

Così proseguendo,

x(n) = anx

e quindi, per t = 0,

x(n)(0) = anx

0.

Dunque, la soluzione x(t)

è di classe C∞

e verifica le condizioni del Teorema 77 su tutti gli intervalli chiusi contenenti

x0.

Dunque, la soluzione si esprime in forma di serie di potenze

x(t) = ∑

n=0+∞ 1

n!antn

D’altra parte si verifica immediatamente che questa è la serie dell’esponenziale e

quindi si ritrova il risultato noto

x(t) = eatx

0.

Consideriamo ora il sistema di equazioni differenziali lineari

ove x→ è un

vettore di ℝn ed

A è una matrice

n × n che è costante, ossia

non dipende n’e da t

n’e da x.

Vogliamo rappresentare la soluzione di questo sistema che verifica l’ulteriore

condizione

x→(t0) = x→0.

E’ facile vedere che tutto ciò che abbiamo detto sulle serie di potenze e sulle serie

di Taylor si estende senza cambiamenti a funzioni a valori vettori o matrici e quindi

è ancora vero che

x→(t) = ∑

n=0+∞ 1

n!An(t − t

0)n x→

0.

Questa serie si indica col simbolo

|

eA(t−t0) = ∑

n=0+∞ 1

n!An(t − t

0)n.

| (2.9) |

Ciò definisce l’esponenziale di una matrice, e la (2.9) rappresenta in forma

compatta le soluzioni dell’equazione differenziale lineare a coeffcienti costanti (2.8):

Osservazione 79 Va notato un fatto importante: l’esponenziale di matrice

può essere un polinomio. Per esempio, se

A = 01 0 0

allora

A2 = 0

e quindi

eAt = 1t

10 :

eAt

è un polinomio di primo grado. Si prova invece che se

A = 0 1 − 1 0

allora

eAt = cos t sin t

− sin t cos t .

Proprietà importanti della matrice esponenziale

eAt sono

espresse dal teorema seguente, che non proviamo:

Teorema 80 Vale:

- AeAt = eAtA.

- det eA = exp{∑

i=1na

ii}.

Dunque, det eA

è sempre diverso da zero: la matrice eA

è invertibile per ogni A.

- eA −1 = e−A.

- Se AB = BA

allora eAeB = eA+B.

In particolare, vale sempre eAteAt′ = eA(t+t′).

- La funzione t → eAt

è derivabile e

d

dteAt = AeAt.

L’introduzione dell’esponenziale eAt

della matrice At

permette anche di rappresentare la soluzione del problema

x→′ = Ax→ + f→(t)x→(t

0) = x→0.

Procediamo esattamente come già si è visto (nel corso di Analisi

Matematica 1) per l’equazione scalare: moltiplicando i due membri per

e−At si

trova

|

e−Atx→′(t) − Ae−Atx→(t) = e−Atf→(t).

| (2.10) |

La regola della derivata del prodotto si estende al prodotto di una matrice per un

vettore

e quindi la (2.10) è

d

dt e−Atx→(t) = e−Atf→(t).

Integrando i due membri da t0

a t si

trova

|

e−Atx→(t) − e−At0

x→0 = ∫

t0te−Asf→(s)ds.

| (2.11) |

Moltiplichiamo i due membri di (2.11) per

eAt e

usiamo le proprietà nel teorema 80. Si trova

x→(t) = eA(t−t0)x→

0 + ∫

0teA(t−s)f→(s)ds.

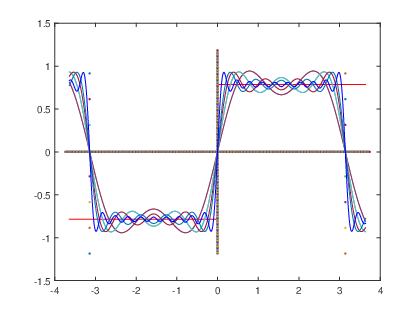

2.5 Serie di Fourier: introduzione

Oltre alle serie di potenze, nelle applicazioni si incontrano molti altri tipo di “serie

di funzioni”, la cui teoria comunque è sostanzialmente più complessa e viene qui

esaminata per sommi capi nel caso di gran lunga più importante delle serie di